KI lokal betreiben: Wie Du unabhängig von Cloud-Anbietern arbeitest

Künstliche Intelligenz ist längst im Arbeitsalltag angekommen – meist bereitgestellt durch Cloud-Dienste, die schnell verfügbar und einfach zu nutzen sind. Doch nicht jedes Unternehmen möchte sensible Daten an externe Anbieter übertragen oder sich dauerhaft an eine Plattform binden. Genau hier kommt die lokale Nutzung von KI ins Spiel, denn lokale KI-Systeme unterstützen die menschliche Arbeit bei Aufgaben wie Textzusammenfassung, Übersetzung oder Lernprozessen, ohne sie zu ersetzen.

Wenn Du KI lokal betreibst, laufen Modelle und Anwendungen direkt auf Deiner eigenen Infrastruktur – sei es auf einem Server im Unternehmen oder sogar auf leistungsfähiger Hardware am Arbeitsplatz. Das gibt Dir nicht nur mehr Kontrolle über Deine Daten, sondern auch über Kosten, Performance und individuelle Anpassungen. Der Betrieb lokaler KI ist heute nicht mehr etwas, das nur große Unternehmen oder IT-Abteilungen umsetzen können – auch kleinere Akteure können eigene KI-Server betreiben und davon profitieren.

In diesem Beitrag erhältst Du einen kompakten Überblick darüber, was es bedeutet, KI lokal zu betreiben, welche Vorteile und Herausforderungen damit verbunden sind und für welche Anwendungsfälle sich dieser Ansatz besonders eignet. Du weißt schon was du willst? Dan kontaktiere uns direkt und gemeinsam setzen wir die Use-Cases mit lokal betriebener KI um!

Was bedeutet KI lokal betreiben?

Wenn Du KI lokal betreibst, bedeutet das, dass die zugrunde liegenden Modelle und Anwendungen direkt auf Deiner eigenen Infrastruktur ausgeführt werden – also auf lokalen Servern, im firmeneigenen Rechenzentrum oder auf dedizierter Hardware vor Ort. Im Gegensatz dazu stehen cloudbasierte Lösungen, bei denen die Verarbeitung über externe Anbieter erfolgt.

Der zentrale Unterschied liegt darin, wo Deine Daten verarbeitet werden. Bei einer lokal betriebenen KI verbleiben alle Eingaben, Auswertungen und Ergebnisse innerhalb Deiner eigenen IT-Umgebung. Du gibst also keine sensiblen Informationen an Dritte weiter und behältst die volle Kontrolle über Datenflüsse und Zugriffsrechte.

Technisch umfasst der lokale Betrieb verschiedene Komponenten: die Bereitstellung geeigneter Hardware (z. B. GPUs), die Installation von KI-Modellen sowie die Integration in bestehende Systeme und Prozesse. Je nach Anwendungsfall kann es sich dabei um vortrainierte Modelle handeln oder um individuell angepasste Lösungen.

Kurz gesagt: KI lokal zu betreiben heißt, künstliche Intelligenz unabhängig von externen Cloud-Diensten zu nutzen – mit mehr Kontrolle, aber auch mit mehr Verantwortung für Betrieb und Wartung.

Typische Use Cases für lokale KI

Lokale KI entfaltet ihren größten Mehrwert dort, wo sensible Daten verarbeitet werden oder Prozesse stark unternehmensspezifisch sind. Die folgenden Use Cases zeigen die Praxis der lokalen KI-Nutzung anhand konkreter Beispiele. Besonders in diesen Bereichen entstehen praxisnahe und schnell umsetzbare Anwendungsfälle:

Interne Wissensdatenbanken und Chatbots

Lokale KI eignet sich ideal für den Aufbau interner Chatbots, die auf Unternehmenswissen zugreifen. Mitarbeiter können Fragen zu Prozessen, Richtlinien oder Dokumentationen direkt stellen, ohne externe Systeme zu nutzen. Dadurch entsteht ein zentraler, sicherer Zugang zu Wissen im Unternehmen.

Dokumentenanalyse von Verträgen und Reports

Ein weiterer häufiger Einsatzbereich ist die Analyse großer Dokumentenmengen. KI kann Verträge, Berichte oder technische Dokumentationen automatisch auswerten, Inhalte zusammenfassen und relevante Informationen extrahieren. Besonders bei sensiblen Dokumenten bietet es große Vorteile, die KI lokal zu betreiben, da die Dokumente das Unternehmen nicht verlassen und somit Datenschutz und Kontrolle gewährleistet bleiben. Das spart Zeit und reduziert manuelle Aufwände deutlich.

Support-Automatisierung im Intranet

Im internen Support kann KI wiederkehrende Anfragen automatisiert beantworten – etwa zu IT-Themen, HR-Prozessen oder internen Tools. Dadurch werden Support-Teams entlastet und Standardanfragen schneller bearbeitet.

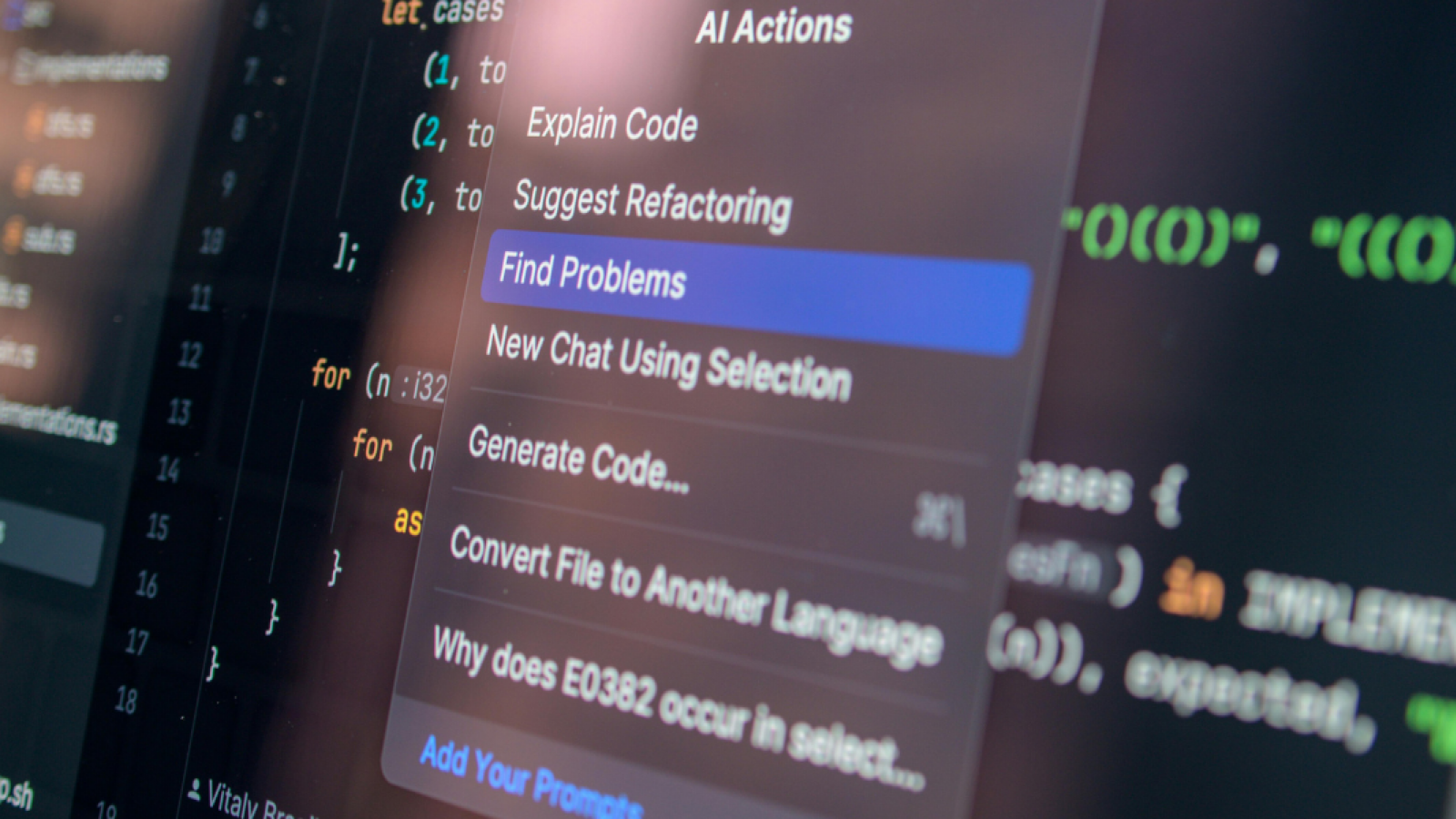

Code-Assistenz für Entwickler

Auch in der Softwareentwicklung bietet lokale KI Vorteile. Sie kann Entwickler bei der Code-Erstellung, Fehleranalyse oder Dokumentation unterstützen, ohne dass sensibler Quellcode externe Systeme verlässt.

Klassifikation von Unternehmensdaten

Lokale KI kann Daten automatisch kategorisieren, strukturieren und taggen. Das ist besonders hilfreich bei großen Datenbeständen, etwa in CRM-Systemen, E-Mail-Archiven oder Dokumentenmanagement-Systemen.

Welche Gründe sprechen für das lokale Betreiben von KI

Der lokale Betrieb von KI bringt eine Reihe von Vorteilen mit sich und eröffnet vielfältige Möglichkeiten, wie KI-Modelle flexibel und bedarfsgerecht eingesetzt werden können, die je nach Anwendungsfall und Unternehmensanforderung unterschiedlich stark ins Gewicht fallen. Die wichtigsten Aspekte im Überblick:

Grund #1: Mehr Datenschutz und Datensouveränität

Einer der zentralen Gründe für lokale KI ist der Schutz sensibler Daten. Wenn Du KI auf Deiner eigenen Infrastruktur betreibst, bleiben alle Informationen innerhalb Deiner IT-Umgebung. Das reduziert das Risiko von Datenabflüssen und erleichtert die Einhaltung von Datenschutzvorgaben und Compliance-Richtlinien.

Grund #2: Volle Kontrolle über Systeme und Prozesse

Beim lokalen Betrieb bestimmst Du selbst, wie die KI eingesetzt wird, welche Daten verarbeitet werden und wer Zugriff hat. Du bist nicht von den Vorgaben oder Änderungen eines Cloud-Anbieters abhängig und kannst Systeme individuell anpassen.

Grund #3: Unabhängigkeit von externen Anbietern

Cloud-Dienste sind oft mit einer langfristigen Bindung verbunden. Lokale KI-Lösungen geben Dir die Möglichkeit, unabhängig zu arbeiten und eigene Technologien flexibel weiterzuentwickeln, ohne auf Preisänderungen oder Einschränkungen reagieren zu müssen.

Grund #4: Bessere Kostenkontrolle bei langfristiger Nutzung

Während Cloud-Lösungen häufig nutzungsabhängige Kosten verursachen, investierst Du bei lokaler KI vor allem initial in Hardware und Einrichtung. Bei regelmäßiger und intensiver Nutzung kann sich das langfristig wirtschaftlich auszahlen.

Grund #5: Hohe Performance und geringe Latenz

Da die Verarbeitung direkt vor Ort erfolgt, entfallen Übertragungszeiten in externe Rechenzentren. Das kann insbesondere bei zeitkritischen Anwendungen zu schnelleren Reaktionszeiten führen.

Grund #6: Individuelle Anpassbarkeit der KI-Lösungen

Lokale KI-Systeme lassen sich gezielt an Deine Anforderungen anpassen – etwa durch eigene Trainingsdaten, spezielle Schnittstellen oder maßgeschneiderte Workflows. So kannst Du Lösungen entwickeln, die exakt zu Deinen Prozessen passen.

Grund #7: Unabhängigkeit von einer Internetverbindung

Ein weiterer Vorteil: Lokale KI funktioniert unabhängig vom Internet und benötigt keine ständige Internetverbindung. Das ist besonders relevant in sensiblen Umgebungen oder in Szenarien mit eingeschränkter Konnektivität. Selbst bei einem Internetausfall bleiben lokale KI-Systeme weiterhin voll funktionsfähig.

Insgesamt bietet der lokale Betrieb von KI vor allem dort klare Vorteile, wo Kontrolle, Datenschutz und individuelle Anpassung im Vordergrund stehen.

Lokale KI vs. Cloud-KI im direkten Vergleich

Die Entscheidung zwischen lokaler KI und anderen KI-Systemen wie Cloud-KI hängt stark von den individuellen Anforderungen eines Unternehmens ab. Beide Ansätze haben klare Stärken und Schwächen:

Kostenstruktur

Cloud-KI basiert meist auf nutzungsabhängigen Gebühren, während lokale KI höhere Anfangsinvestitionen in Hardware und Aufbau erfordert. Langfristig kann sich der lokale Betrieb bei hoher Nutzung wirtschaftlich lohnen.

Datenschutz

Bei lokaler KI bleiben alle Daten im eigenen Unternehmen, was maximale Kontrolle und Datensouveränität ermöglicht. Cloud-KI verarbeitet Daten außerhalb der eigenen Infrastruktur, was je nach Branche regulatorische Herausforderungen mit sich bringen kann.

Performance und Latenz

Lokale KI bietet in der Regel geringere Latenzen, da keine Daten an externe Server übertragen werden müssen. Cloud-Lösungen sind dagegen von der Internetverbindung und Serverauslastung abhängig.

Flexibilität

Cloud-KI ist schnell einsatzbereit und einfach skalierbar. Lokale KI bietet dafür deutlich mehr Anpassungsmöglichkeiten und Kontrolle über Modelle, Daten und Prozesse.

Wartungsaufwand

Bei Cloud-KI übernimmt der Anbieter Wartung, Updates und Betrieb. Bei lokaler KI liegt dieser Aufwand beim Unternehmen selbst, was zusätzliche technische Ressourcen erfordert.

GPT4YOU als ideale Lösung für den lokalen KI-Betrieb

Mit GPT4YOU steht Dir eine Lösung zur Verfügung, die gezielt für den flexiblen und sicheren Einsatz von KI in Unternehmen entwickelt wurde und sich besonders gut für den lokalen Betrieb eignet. Ein zentraler Vorteil ist die Möglichkeit, die Plattform vollständig On-Premise auf Deiner eigenen Infrastruktur zu betreiben. Dadurch behältst Du die volle Kontrolle über Deine Daten und erfüllst gleichzeitig hohe Anforderungen an Datenschutz und Compliance.

Ein weiterer Vorteil liegt in der technischen Flexibilität: Du kannst verschiedene KI-Modelle integrieren und je nach Anwendungsfall auswählen. Gleichzeitig lässt sich die Plattform individuell an Deine Prozesse und Anforderungen anpassen – von Benutzerrollen bis hin zur Benutzeroberfläche und deinen Use-Cases.

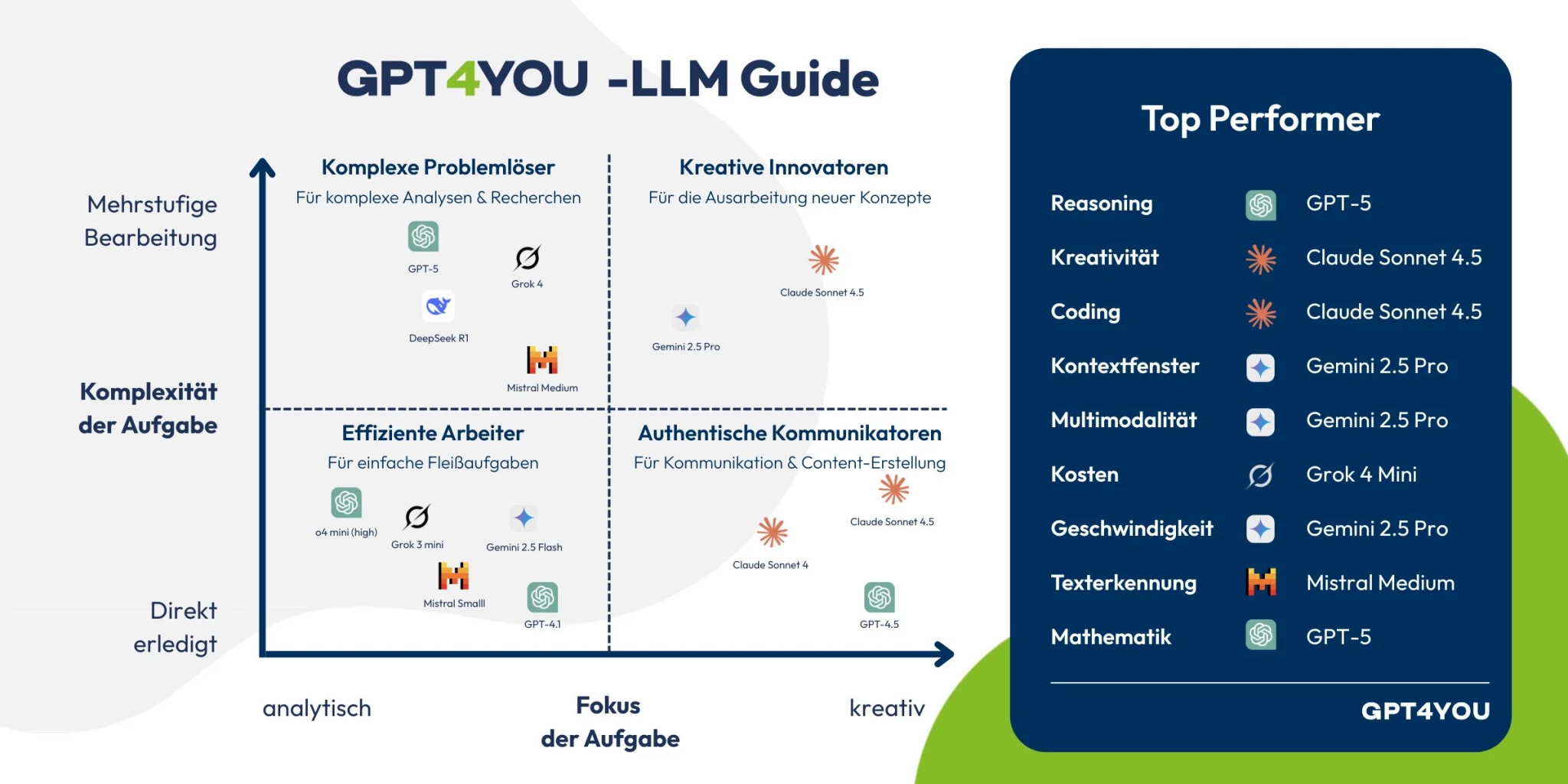

Welche LLMs eignen sich für den lokalen Betrieb mit GPT4YOU?

Viele bekannte kommerzielle LLMs laufen primär in der Cloud, lassen sich jedoch an GPT4YOU anbinden und so lokal nutzen.

ChatGPT (OpenAI)

ChatGPT zählt zu den leistungsstärksten KI-Systemen, ist jedoch ohne GPT4YOU nicht lokal betreibbar.

Vorteile: Sehr hohe Qualität, vielseitig einsetzbar, starke API-Integration

Nachteile: Kein On-Premise-Betrieb, Datenverarbeitung extern

Einsatz: Integration in bestehende Anwendungen über Schnittstellen

Claude (Anthropic)

Claude ist ebenfalls ein normalerweise cloudbasiertes LLM mit Fokus auf lange, strukturierte Texte und Analysen. Mit GPT4YOU kannst du Claude ohne Probleme lokal nutzen!

Vorteile: Sehr gute Textverständnis- und Analysefähigkeiten

Nachteile: Kein lokaler Betrieb möglich

Einsatz: Wissensarbeit und Textanalyse

DeepSeek

DeepSeek bietet Modelle, die teilweise als Open-Weights verfügbar sind und sich lokal betreiben lassen.

Vorteile: Lokal nutzbar, gute Performance bei moderatem Ressourcenbedarf

Nachteile: Unterschiedliche Modellqualität je nach Version

Einsatz: Self-Hosting und individuelle KI-Lösungen

Welche Hardware brauchst Du für den lokalen Betrieb von KI?

Die Anforderungen an die Hardware hängen stark davon ab, welche Art von KI Du einsetzen möchtest und wie intensiv die Nutzung ist. Für einfache Anwendungsfälle, wie kleinere Modelle oder erste Tests, kann bereits ein leistungsstarker Desktop-PC mit moderner CPU und ausreichend Arbeitsspeicher ausreichen.

Sobald Du jedoch größere KI-Modelle – etwa Sprachmodelle oder Bildverarbeitungssysteme – lokal betreiben willst, spielt die Grafikkarte (GPU) eine entscheidende Rolle. GPUs sind darauf spezialisiert, viele Rechenoperationen parallel auszuführen, was für KI-Anwendungen essenziell ist. Wichtig sind hier vor allem ausreichend Videospeicher (VRAM) und eine gute Unterstützung durch gängige Frameworks.

Neben der GPU solltest Du auch auf genügend RAM achten, da viele Modelle zusätzliche Ressourcen im Arbeitsspeicher benötigen. Für produktive Umgebungen kommen häufig dedizierte Server oder Workstations zum Einsatz, die speziell für rechenintensive Anwendungen ausgelegt sind.

Auch der Speicherplatz ist nicht zu unterschätzen: KI-Modelle können mehrere Gigabyte groß sein, hinzu kommen Trainingsdaten, Logs und weitere Systemkomponenten. Schnelle SSDs sorgen hier für kürzere Ladezeiten und eine insgesamt bessere Performance.

Zusammengefasst gilt: Je komplexer und leistungsfähiger die eingesetzte KI sein soll, desto höher sind die Anforderungen an Deine Hardware. Eine sorgfältige Planung hilft Dir, die passende Infrastruktur für Deinen Anwendungsfall aufzubauen.

Beispiel: Setup für ein kleines Unternehmen

Für kleinere Unternehmen oder erste Pilotprojekte reicht oft eine kompakte, aber leistungsfähige Workstation:

CPU: Aktueller Mehrkern-Prozessor (z. B. 8–16 Kerne)

GPU: Mittelklasse-Grafikkarte mit 16 GB VRAM

RAM: 32–64 GB

Speicher: 1–2 TB SSD (vorzugsweise NVMe)

Einsatz:

Lokale Chatbots

Textverarbeitung mit kleineren Sprachmodellen

Erste Automatisierungen und Analysen

Dieses Setup eignet sich gut, um Erfahrungen zu sammeln, kleinere KI-Anwendungen produktiv einzusetzen und erste Prozesse zu optimieren – ohne direkt in komplexe Infrastruktur investieren zu müssen.

Beispiel: Setup für ein größeres Unternehmen

Für größere Unternehmen mit intensiver Nutzung oder mehreren parallelen Anwendungen empfiehlt sich eine dedizierte Serverlösung:

CPU: Leistungsstarker Server-Prozessor (z. B. 16–64 Kerne)

GPU: Eine oder mehrere High-End-GPUs mit 24+ GB VRAM

RAM: 128–512 GB

Speicher: 4–10 TB SSD (NVMe, ggf. ergänzt durch Netzwerkspeicher)

Netzwerk: Schnelle interne Anbindung (z. B. 10 Gbit)

Einsatz:

Betrieb größerer Sprachmodelle

Verarbeitung großer Datenmengen

Mehrere gleichzeitige Nutzer und Anwendungen

Integration in bestehende Unternehmenssysteme

Ein solches Setup bietet die nötige Leistung und Skalierbarkeit, um KI fest in Geschäftsprozesse zu integrieren und unternehmensweit nutzbar zu machen.

Wie die FIDA Dich als KI-Partner unterstützt

Die FIDA begleitet Dich ganzheitlich bei der Einführung und dem Betrieb von künstlicher Intelligenz im Unternehmen – von der Strategie bis zur technischen Umsetzung.

KI-Beratung und strategische Einordnung

Im ersten Schritt starten wir mit einer fundierten KI-Beratung. Gemeinsam werden Anforderungen analysiert, potenzielle Einsatzbereiche identifiziert und sinnvolle Szenarien für den Einsatz lokaler oder hybrider KI-Lösungen definiert.

Umsetzung individueller KI-Use-Cases

Darauf aufbauend entwickelt identifizieren wir individuelle Use Cases, die künftig mit KI beschleunigt werden sollen. Ziel ist es, KI nicht isoliert zu betrachten, sondern direkt in bestehende Abläufe und Systeme zu integrieren.

Unterstützung bei der Hardware-Auswahl für den lokalen Betrieb

Ein zentraler Erfolgsfaktor für lokale KI ist die passende Infrastruktur. Die FIDA unterstützt Dich bei der Auswahl geeigneter Hardware, abgestimmt auf Leistungsanforderungen, Skalierbarkeit und Budget.

Installation und Integration von KI-Modellen

Die technische Umsetzung umfasst die Installation und Konfiguration geeigneter KI-Modelle sowie deren Integration in Deine bestehende IT-Umgebung. So entsteht eine stabile und produktionsreife Lösung für den täglichen Einsatz.

Schulungen und Enablement

Damit KI im Unternehmen erfolgreich genutzt werden kann, bietet die FIDAcademy praxisnahe KI-Schulungen an. Dabei werden sowohl technische Grundlagen als auch konkrete Anwendungsfälle vermittelt, sodass Teams KI sicher und effizient einsetzen können.

KI lokal betreiben als strategischer Wettbewerbsvorteil

Der lokale Betrieb von KI bietet Unternehmen die Möglichkeit, künstliche Intelligenz unabhängig, sicher und individuell in die eigene IT-Landschaft zu integrieren. Besonders dort, wo Datenschutz, Kontrolle über Daten und maßgeschneiderte Anwendungen im Vordergrund stehen, entfaltet dieser Ansatz sein volles Potenzial. Gleichzeitig erfordert er eine sorgfältige Planung hinsichtlich Hardware, Modellwahl und technischer Umsetzung.

Ob interne Chatbots, Dokumentenanalyse oder Automatisierung von Prozessen – lokale KI eröffnet vielfältige Einsatzmöglichkeiten, die direkt auf die Bedürfnisse Deines Unternehmens zugeschnitten werden können. Lokale KI-Modelle können beispielsweise Text zusammenfassen, übersetzen, Lernhilfe bieten oder Inhalte erklären, wobei die kritische Prüfung der Ergebnisse stets beim Menschen bleibt. Bei sehr langen Texten stoßen lokal betriebene KIs jedoch oft an ihre Grenzen, da sie nicht immer über die nötige Rechenleistung und den Speicher verfügen, um umfangreiche Dokumente vollständig zu verarbeiten. Die Nutzung lokaler KI-Modelle minimiert zudem das Risiko in Bezug auf Datenschutz und Datensicherheit, was insbesondere für Unternehmen und Privatpersonen mit sensiblen Daten ein entscheidender Vorteil ist. Im Vergleich zur Cloud überzeugt sie vor allem durch Datensouveränität und Flexibilität, bringt jedoch auch höhere Anforderungen an Betrieb und Know-how mit sich.

Wenn Du herausfinden möchtest, wie KI konkret in Deinem Unternehmen eingesetzt werden kann, unterstützt Dich die FIDA von der ersten Idee bis zur produktiven Lösung. Von der strategischen Beratung über die Auswahl der passenden Hardware bis hin zur technischen Umsetzung und Schulung erhältst Du alles aus einer Hand.

FAQ – KI lokal betreiben

KI lokal zu betreiben bedeutet, dass Modelle und Anwendungen nicht in der Cloud, sondern auf eigener Infrastruktur ausgeführt werden. Die Datenverarbeitung erfolgt vollständig im Unternehmen, zum Beispiel auf lokalen Servern oder Workstations.

Der größte Vorteil ist die Datensouveränität, da keine sensiblen Informationen an externe Anbieter übertragen werden. Zusätzlich profitierst Du von mehr Kontrolle, geringeren Latenzen und individuellen Anpassungsmöglichkeiten. Cloud-KI ist dafür schneller startklar und einfacher skalierbar.

Das hängt vom Anwendungsfall ab. Für kleinere Modelle reicht oft eine leistungsstarke Workstation. Für größere KI-Modelle werden GPUs mit viel VRAM, ausreichend RAM (ab 64 GB) und schnelle SSDs benötigt. In größeren Umgebungen kommen dedizierte Server zum Einsatz.

Es eignen sich vor allem Open-Weight-Modelle wie DeepSeek oder andere frei verfügbare LLMs. Kommerzielle Modelle wie ChatGPT, Claude oder Gemini sind überwiegend cloudbasiert und können nur über Schnittstellen eingebunden werden.

Ja, lokale KI kann besonders gut DSGVO-konform betrieben werden, da Daten im eigenen Unternehmen bleiben. Voraussetzung ist jedoch, dass interne Sicherheits- und Zugriffsrichtlinien korrekt umgesetzt werden.

Lokale KI eignet sich besonders für Unternehmen, die mit sensiblen Daten arbeiten oder hohe Anforderungen an Datenschutz und Kontrolle haben. Typische Branchen sind Industrie, Finanzwesen, Verwaltung und IT-nahe Dienstleister.

Der Einstieg erfordert eine gewisse technische Planung, insbesondere bei Hardware und Modellwahl. Mit einem klar definierten Use Case und professioneller Unterstützung lässt sich der Einstieg jedoch gut strukturieren und schrittweise umsetzen.