Cosa sono i processi ETL? - Definizione, vantaggi e applicazioni

Vi siete mai chiesti come fanno le grandi organizzazioni a mettere insieme montagne di dati provenienti da fonti diverse, a ripulirli e a utilizzarli per prendere decisioni importanti? Non si tratta di scienza missilistica, ma di un metodo meticoloso che costituisce la spina dorsale di ogni moderna analisi dei dati.

Nel mondo digitale di oggi, i dati sono la risorsa più importante. Ma i dati non strutturati in diversi sistemi sono come diamanti grezzi, preziosi ma inutili finché non vengono lucidati. È proprio qui che entra in gioco il processo ETL. Il nome completo di ETL è "Extract, Transform, Load" e descrive le tre fasi centrali con cui i dati grezzi vengono preparati per i data warehouse, i data lake o le analisi di business intelligence.

Estrarre, trasformare, caricare: queste tre fasi sono la chiave per trasformare i dati grezzi in informazioni significative. Il termine "ETL" viene spesso utilizzato nel contesto dell'integrazione e della migrazione dei dati e si differenzia da altri termini come ELT (Extract, Load, Transform) e DWH (Data Warehouse), che hanno ciascuno il proprio focus e le proprie aree di applicazione. In questo articolo vogliamo mostrarvi cosa significa realmente ETL, perché è essenziale per la vostra azienda e come possiamo ottimizzare i vostri progetti sui dati insieme.

Definizione: cos'è il processo ETL?

L'ETL è il metodo tecnico utilizzato nell'IT per integrare e standardizzare in modo efficiente i dati provenienti da fonti eterogenee e renderli disponibili per l'analisi in un sistema centrale di destinazione. È il vostro strumento per gestire la complessità del panorama dei dati. L'uso di un processo ETL è necessario perché i dati rilevanti per l'azienda provengono da diverse fonti interne ed esterne.

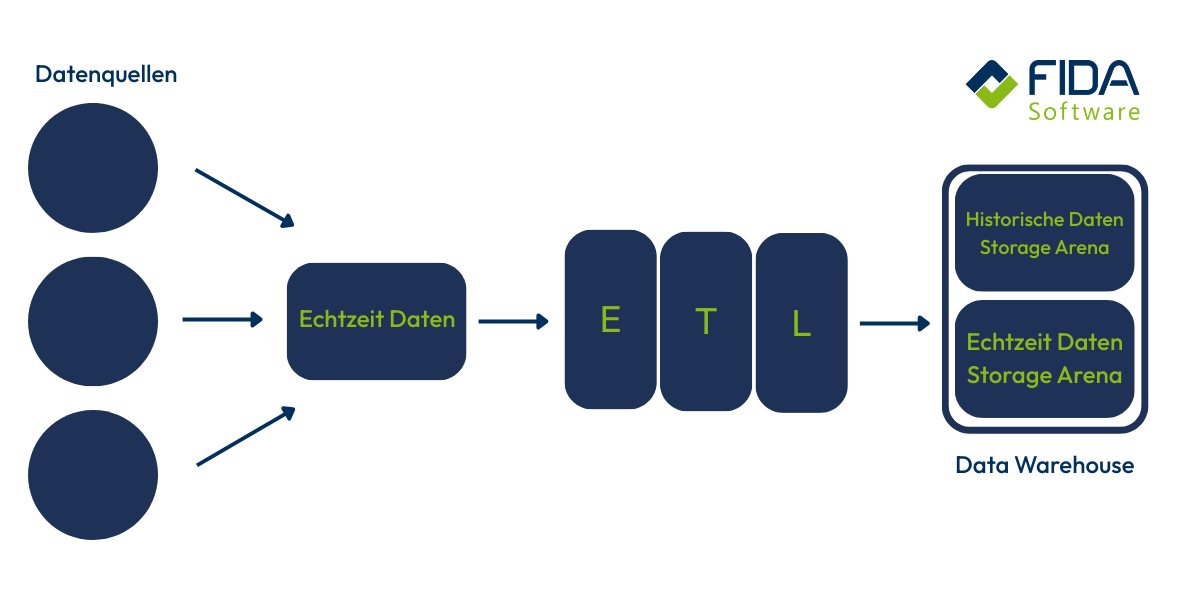

Quando si parla di gestione e analisi di grandi quantità di dati, è inevitabile imbattersi nel processo ETL. Questo processo costituisce la base di ogni data warehouse e di ogni soluzione di BI. Il processo ETL è costituito da diverse fasi individuali chiaramente definite che si svolgono in sequenza e strutturano la preparazione dei dati.

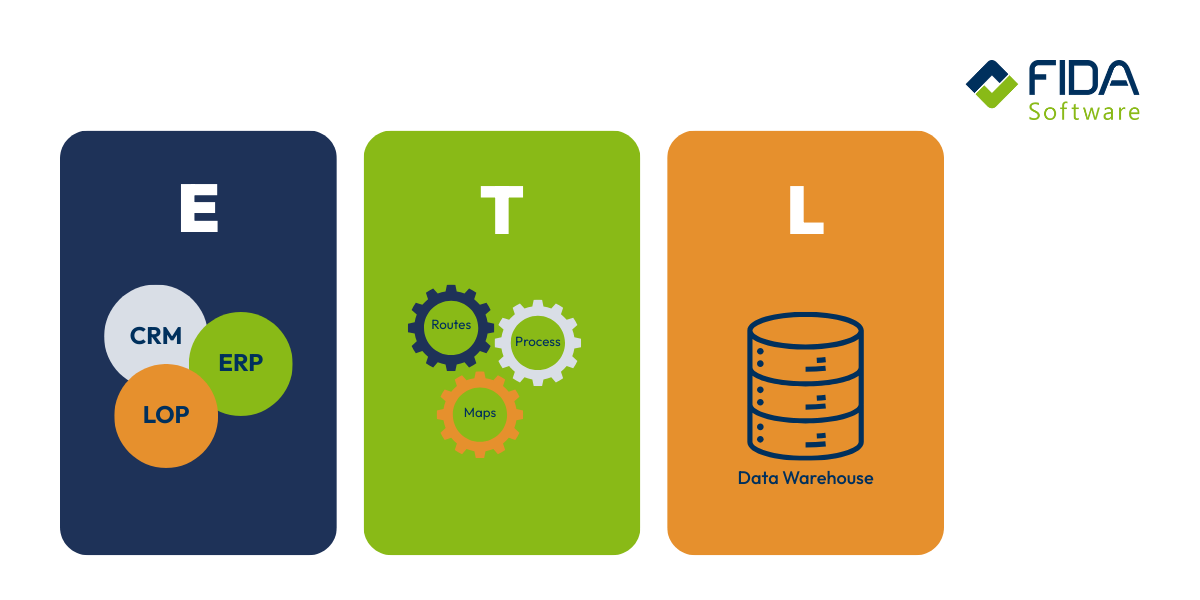

I dati rilevanti per l'azienda provengono spesso da un'ampia varietà di fonti interne (ad esempio, ERP, CRM) ed esterne (ad esempio, dati di mercato, social media). Per rendere questi dati utilizzabili come informazioni, sono necessarie le seguenti tre fasi successive:

Estrazione / Estrazione (approvvigionamento dei dati): In questa fase, i dati grezzi vengono estratti dai vari sistemi di origine.

Trasformazione (affinamento dei dati): È la fase cruciale in cui i dati estratti vengono trasformati. La trasformazione dei dati comporta la standardizzazione, la conversione e la pulizia dei dati grezzi.

Caricamento (fornitura dei dati): Nella fase finale, i dati completamente preparati e strutturati vengono trasferiti al sistema centrale di destinazione, di solito il data warehouse, dove vengono resi accessibili alle applicazioni analitiche.

Queste tre fasi assicurano che sia sempre disponibile un database coerente, di alta qualità e completo per le vostre analisi. I processi ETL garantiscono che i dati coerenti e puliti raggiungano il data warehouse.

Perché i processi ETL sono utili?

Perché dovreste impegnarvi nell'implementazione di un processo ETL strutturato? È semplice: i processi ETL sono utilizzati in vari settori e aree aziendali per organizzare i dati provenienti da aree diverse e ottimizzare i processi. Aiutano le organizzazioni di tutte le dimensioni a utilizzare le risorse in modo più efficiente e consentono una migrazione fluida dei dati tra i sistemi. Forniscono la base necessaria per prendere decisioni basate sui dati in modo rapido e affidabile.

Ecco alcuni dei principali vantaggi ottenuti:

Maggiore qualità e coerenza dei dati: la fase di trasformazione obbligatoria consente di ripulire i dati errati o incoerenti ancor prima che vengano caricati. Ciò significa che i dati analizzati sono sempre affidabili e standardizzati. I risultati sono affidabili.

Decisioni fondate: Solo il consolidamento centralizzato di tutte le informazioni rilevanti nel vostro data warehouse vi offre una visione olistica della vostra attività. Potete vedere le correlazioni, riconoscere le tendenze e prendere decisioni basate sui dati piuttosto che sull'istinto.

Analisi con risparmio di tempo: poiché i dati sono già ottimizzati e strutturati nel sistema di destinazione, gli analisti e i responsabili delle decisioni non devono più eseguire una lunga preparazione manuale. Possono iniziare immediatamente l'analisi e concentrarsi sul valore aggiunto.

Conformità e verificabilità: il processo ETL crea una storia chiara di come i dati sono stati trasferiti dal sistema di origine a quello di destinazione. Ciò garantisce un elevato livello di tracciabilità (data lineage) e aiuta a rispettare più facilmente i requisiti legali e le linee guida interne sulla gestione dei dati.

Utilizzo efficiente del sistema: l' estrazione e la trasformazione avvengono al di fuori dei sistemi operativi di origine. Questo evita perdite di prestazioni nelle applicazioni aziendali critiche mentre i dati vengono preparati per l'analisi.

Complessità e query a rischio di errore: se i metodi attuali di interrogazione e fusione dei dati sono troppo inefficienti, a rischio di errore o addirittura impossibili, l'ETL fornisce la struttura necessaria.

Centralizzazione dell'analisi: volete creare un'istanza centrale per tutte le vostre analisi dei dati - il vostro data warehouse. L'ETL garantisce che tutti i dati siano standardizzati e trasportati lì.

Grandi dati e formati eterogenei: L'approccio ETL è importante anche per l'apertura e la valutazione di grandi volumi di dati (big data) provenienti da una grande varietà di formati, in quanto fornisce la necessaria standardizzazione.

Non c'è limite alle dimensioni dell'azienda: l'ETL non è solo per le grandi aziende. Questo approccio strutturato è molto importante anche per le piccole e medie imprese (PMI), i cui volumi di dati e le cui esigenze di mercato sono in crescita.

I processi ETL vengono utilizzati anche per attività tecniche come la migrazione dei dati tra applicazioni diverse o la replica dei dati per scopi di backup e archiviazione.

I tre processi principali in dettaglio: E, T e L

Per dominare la complessità della gestione dei dati, è essenziale comprendere a fondo le tre fasi del processo ETL.

Fase 1: estrazione (ottenere i dati di origine)

L'estrazione è la fase iniziale in cui si estraggono i dati grezzi da vari sistemi operativi di origine (come ERP, CRM, database, dati dei sensori). La sfida maggiore è rappresentata dall'eterogeneità delle fonti di dati, che utilizzano formati, tecnologie e modelli di dati diversi. I moderni servizi di dati consentono di estrarre e fornire dati in tempo reale, il che è essenziale per gli attuali processi ETL e le soluzioni di integrazione dei dati. Le piattaforme cloud come AWS offrono potenti servizi per l'estrazione, la trasformazione e il caricamento dei dati, soprattutto per l'integrazione in ambienti di data warehouse.

È necessario decidere quale strategia di estrazione si adatta meglio ai propri sistemi e requisiti:

Estrazione completa (statica): Quando si popola per la prima volta il data warehouse o si ripristina un sistema, è necessaria un'estrazione completa. Crea un'immagine completa dell'origine, ma richiede molto tempo e risorse.

Estrazione delta (incrementale): L'estrazione delta è più efficiente per le operazioni in corso. Si leggono solo i record di dati che sono cambiati dall'ultima esecuzione. Spesso ciò avviene tramite i campi timestamp o i registri delle transazioni (Change Data Capture) dei sistemi di origine.

Tipo di trasferimento: è necessario specificare se l'estrazione è sincrona (elaborazione immediata, elevato utilizzo della rete) o asincrona (elaborazione ritardata, maggiore efficienza delle risorse). L'estrazione può essere sincrona o asincrona, con l'estrazione sincrona che aggiorna continuamente i set di dati. La scelta influisce direttamente sull'aggiornamento delle analisi.

Il risultato di questa fase sono i dati grezzi nell'area di staging, una cache che serve come base per la trasformazione. Un'archiviazione efficiente dei dati nell'area di staging e negli ambienti cloud è fondamentale per creare una base solida per l'ulteriore elaborazione e analisi dei dati.

Fase 2: trasformazione (affinamento e pulizia)

La fase di trasformazione è fondamentale per la qualità. Il suo compito è quello di portare i dati grezzi eterogenei nel formato standardizzato e nella struttura coerente richiesti dal data warehouse. Il processo di trasformazione porta i dati estratti in un formato standardizzato che può essere utilizzato all'interno dell'azienda. Senza questa fase, le analisi si baserebbero su informazioni errate o contraddittorie.

Nella fase di trasformazione si eseguono diverse operazioni critiche, che si riassumono nella pulizia dei dati:

Pulizia: Identificare e correggere gli errori dei dati (ad esempio, errori di battitura, valori mancanti, formati non validi). Si deve decidere se eliminare o correggere i record di dati errati o aggiungere i valori mancanti.

Standardizzazione e normalizzazione: si assicura che i campi di dati (ad esempio, indirizzi, valori di date) siano visualizzati in modo uniforme in tutte le fonti, per garantire la coerenza semantica.

Aggregazione e derivazione: si combinano i dati (ad esempio, il fatturato mensile anziché le singole transazioni) o si ricavano nuove metriche importanti per le analisi, ma che non esistono nei sistemi di origine.

Collegamento e arricchimento: si uniscono dati provenienti da fonti diverse (ad esempio, l'ID del cliente dal CRM con i dati dell'ordine dall'ERP) e si arricchiscono i record di dati con informazioni aggiuntive e rilevanti.

Profilazione dei dati: la profilazione dei dati viene utilizzata come metodo automatizzato per analizzare e valutare la qualità dei dati durante il processo di trasformazione.

L'obiettivo è eliminare le anomalie (record di dati errati o ridondanti) in modo da ottenere informazioni affidabili per i report.

Fase 3: Caricamento (la distribuzione finale)

Nella fase finale, si trasferiscono i dati, ora completamente puliti e strutturati, dall'area di staging al sistema di destinazione, di solito il data warehouse (DWH) o un data store operativo (ODS).

Anche in questo caso esistono diverse strategie, a seconda dei requisiti di aggiornamento e disponibilità del sistema:

Carico iniziale: La prima volta che il DWH viene caricato con il set di dati completo.

Carico incrementale: L'aggiunta o l'aggiornamento periodico dei dati delta determinati nella fase di estrazione.

Verifica e integrità: durante il processo di caricamento devono essere eseguiti controlli di integrità per garantire che i dati siano inseriti correttamente nella tabella di destinazione.

Possono essere necessari tempi di blocco, soprattutto per grandi quantità di dati. Questi impediscono agli analisti o ai sistemi di BI di accedere ai dati mentre il processo di caricamento è ancora in corso, garantendo così l'integrità dei dati. Solo quando il processo è stato completato con successo è possibile garantire che tutte le query siano basate sulle informazioni più aggiornate e coerenti.

Desiderate un supporto per l'implementazione o l'ottimizzazione di un processo ETL? Allora contattateci!

Quali sono i requisiti di un processo ETL per la vostra infrastruttura?

Il successo dell'implementazione e del funzionamento di un processo ETL richiede requisiti chiari alla vostra infrastruttura IT. Sono necessari componenti potenti per garantire che l'elaborazione dei dati avvenga in modo rapido e affidabile.

Ecco i componenti centrali dell'infrastruttura che dovete fornire:

Il server ETL (istanza di elaborazione): La trasformazione è ad alta intensità di calcolo. È quindi necessario un server dedicato o una macchina virtuale con potenza CPU e RAM sufficienti. Questo server esegue gli strumenti ETL veri e propri e gestisce la logica complessa per la pulizia e la strutturazione dei dati. È necessaria un'elevata potenza di calcolo per completare i processi entro una finestra temporale accettabile.

L'area di staging: come già detto, i dati grezzi estratti richiedono un buffer temporaneo prima di essere trasformati. Quest'area di staging richiede uno spazio di archiviazione veloce con elevate prestazioni di I/O (input/output), poiché grandi quantità di dati devono essere lette e scritte rapidamente. A questo scopo, spesso si utilizza un database o un file storage ad alte prestazioni.

Il sistema di destinazione (data warehouse): Il data warehouse (DWH) o operational data store (ODS) è la destinazione finale. Questo sistema deve essere estremamente scalabile e ottimizzato per le query analitiche. La tecnologia dei database svolge un ruolo cruciale in questo caso, in quanto deve memorizzare in modo efficiente i grandi volumi di dati strutturati e garantire tempi di risposta rapidi per gli strumenti di business intelligence (BI).

Capacità di rete: durante le fasi di estrazione e caricamento, spesso vengono spostati in rete volumi di dati molto elevati, dai sistemi di origine al server ETL e dal server ETL al DWH. Una larghezza di banda sufficiente e una rete stabile sono fondamentali per evitare colli di bottiglia e lunghi tempi di esecuzione.

Monitoraggio e manutenzione: sono necessari strumenti robusti per monitorare il processo ETL. Ciò include funzioni di pianificazione e di registrazione per garantire che i processi vengano avviati in tempo, che gli errori vengano registrati e che si possa reagire rapidamente in caso di guasti.

Tenendo conto di questi requisiti e dimensionando correttamente l'infrastruttura, si creano le basi per un flusso di dati efficiente e affidabile in azienda.

ETL vs. ELT: qual è la differenza?

Nel mondo moderno dei dati, accanto al classico approccio ETL è emersa un'importante alternativa: ELT(Extract, Load, Transform). Mentre nel processo ETL la trasformazione avviene prima del caricamento nel sistema di destinazione, il processo ELT si differenzia per il fatto che i dati vengono prima caricati completamente nel sistema di destinazione e solo successivamente trasformati. Sebbene le fasi siano le stesse, la diversa sequenza porta a un approccio fondamentalmente diverso all'integrazione dei dati.

Con l'ETL classico, si estraggono i dati (Extract), li si perfeziona su un server ETL separato (Transform) e solo successivamente si caricano i dati finiti e puliti nel data warehouse (Load). In questo caso, la trasformazione ad alta intensità di calcolo avviene al di fuori del sistema di destinazione. Questa soluzione ha spesso senso con le vecchie tecnologie di database o se si vogliono salvare solo i record di dati assolutamente necessari e magri.

L'approccio ELT inverte le ultime due fasi. In questo caso, i dati grezzi vengono prima caricati completamente nel data warehouse dopo l'estrazione (Load). La trasformazione (T) avviene quindi all'interno del sistema di destinazione, in genere utilizzando l'elevata potenza di calcolo dei moderni data warehouse cloud (come Snowflake o BigQuery). Il processo di ELT consente quindi una fornitura di dati più rapida, poiché la trasformazione avviene solo dopo il caricamento.

Il vantaggio principale dell'approccio ELT risiede nella sua flessibilità e nell'archiviazione dei dati grezzi. Poiché tutti i dati sono immediatamente disponibili nel DWH, è possibile eseguire trasformazioni in qualsiasi momento e più volte con logiche diverse. Non avete bisogno di un server ETL dedicato perché utilizzate la potenza di calcolo del vostro data warehouse. Se si opta per l'ELT, di solito è un indicatore del fatto che si lavora con grandi quantità di dati (big data) e si vogliono sfruttare i vantaggi della scalabilità del cloud.

Strumenti software rilevanti per il vostro processo ETL

Per implementare i processi ETL e ELT in modo efficiente, è necessario il software giusto. Il panorama degli strumenti è vario e può essere suddiviso grossomodo in tre categorie:

Strumenti cloud-native e hyperscaler (incentrati sul PFU)

Questi strumenti sono spesso strettamente integrati nelle piattaforme cloud e sono ideali per il moderno approccio ELT in quanto sfruttano la potenza di calcolo del cloud:

Azure Data Factory (ADF): Strumento di integrazione centrale di Microsoft Azure. Ideale se si utilizza già Azure Cloud.

Google Cloud Dataflow: un servizio completamente gestito da Google, particolarmente adatto all'elaborazione di dati complessi, in streaming e in batch.

AWS Glue: il servizio ETL serverless di Amazon Web Services in grado di riconoscere automaticamente i metadati (schemi).

Piattaforme ETL tradizionali

Questi strumenti consolidati offrono funzioni molto ampie, elevata scalabilità e sono spesso utilizzati in ambienti aziendali complessi:

Informatica PowerCenter: Uno dei leader di mercato, noto per la sua stabilità e l'ampia connettività.

IBM DataStage: una piattaforma potente, particolarmente adatta a grandi volumi di dati e a requisiti di qualità elevati.

Soluzioni open source

Se cercate un'alternativa economica e flessibile, gli strumenti open source sono una buona opzione che potete personalizzare da soli:

Apache Nifi: un sistema facile da usare, potente e affidabile per automatizzare il flusso di dati tra sistemi software.

La scelta dello strumento giusto dipende in larga misura dall'infrastruttura esistente, dal budget e dalla complessità dei requisiti di integrazione dei dati.

Conclusione: la chiave per la sovranità dei dati

Il processo ETL è molto più di un semplice acronimo tecnico: è la base su cui costruire l'intera strategia dei dati. Sia che si scelga il percorso classico dell'ETL, sia che si prediliga la moderna flessibilità dell'ELT, l'obiettivo rimane lo stesso: trasformare dati grezzi e distribuiti in una base di informazioni coerente e di alta qualità che consenta di prendere decisioni aziendali più rapide e informate.

Tuttavia, la scelta e la corretta implementazione dell'approccio giusto è complessa e dipende dalla vostra infrastruttura e dai vostri requisiti specifici. È proprio qui che siamo al vostro fianco.

In qualità di partner per le soluzioni dati, vi offriamo una competenza completa: analizziamo il vostro panorama di dati, vi consigliamo sulla scelta tra ETL e ELT e ci occupiamo dell'implementazione professionale e dell'ottimizzazione dei vostri processi ETL. In questo modo, vi garantiamo un flusso di dati stabile e ad alte prestazioni, in modo che possiate concentrarvi completamente sull'analisi e sull'aumento del vostro successo aziendale.

Parlate con noi: insieme daremo ordine e valore ai vostri dati.

FAQ Domande frequenti sul processo ETL

Il termine integrazione dei dati è un termine generico e descrive l'obiettivo generale, ovvero la fusione di dati provenienti da fonti diverse. Il processo ETL (Extract, Transform, Load) è uno dei metodi o delle tecniche principali per raggiungere questo obiettivo. L'integrazione dei dati può includere anche altre tecniche come la virtualizzazione o l'ELT.

Un data warehouse è un sistema centrale di database appositamente ottimizzato per scopi analitici. Memorizza dati storici e consolidati. Il processo ETL svolge il ruolo principale nella creazione e nel mantenimento del DWH, estraendo i dati grezzi dai sistemi operativi, pulendoli e caricandoli nel DWH. Il DWH è quindi il principale sistema di destinazione del processo ETL.

La frequenza di esecuzione dipende dall'aggiornamento dei dati:

Elaborazione in batch: per la reportistica giornaliera, settimanale o mensile, il processo viene eseguito a intervalli di tempo fissi (batch).

Quasi in tempo reale: se avete bisogno di informazioni più rapide, il processo viene eseguito più frequentemente (ad esempio ogni 5 minuti) oppure viene utilizzato l'approccio ELT con tecnologie di streaming per fornire i dati quasi immediatamente.

Un processo ETL difettoso può avere gravi conseguenze. Il problema principale è la scarsa qualità dei dati nel data warehouse. Questo porta a prendere decisioni basate su informazioni errate o incomplete. Processi inefficienti possono anche comportare costi infrastrutturali inutilmente elevati o sovraccaricare i sistemi operativi di origine.

Il data lineage descrive il ciclo di vita di un set di dati, dalla sua creazione nell'origine attraverso tutte le fasi di trasformazione fino all'archiviazione finale nel data warehouse. Un processo ETL chiaramente documentato garantisce il data lineage e rende sempre rintracciabile l'origine dei dati, un aspetto importante per gli audit e la conformità.