Versicherungsbetrug durch manipulierte MRT- & Röntgenbilder, wie groß ist die Gefahr?

Lange galten medizinische Bilddaten als verlässliche „Quelle der Wahrheit“. Röntgenbilder, MRTs oder CT-Scans lieferten scheinbar eindeutige Beweise für Diagnosen und bildeten die Grundlage für Leistungsentscheidungen in der Versicherungswirtschaft. Doch dieser Status gerät zunehmend ins Wanken, denn manipulierte Röntgenbilder stellen eine neue Herausforderung für Versicherer dar.

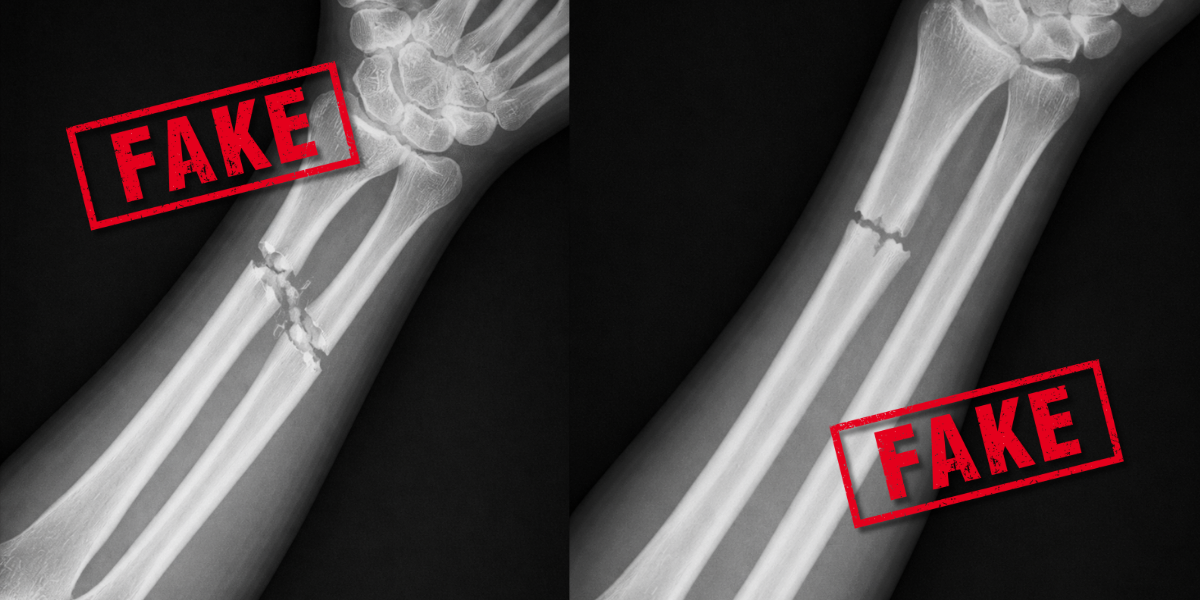

KI Röntgenbilder können so überzeugend sein, dass selbst erfahrene Radiologen sie oft nicht sicher von echten Aufnahmen unterscheiden können. Den Umfang dieser neuen Problematik, zeigen neueste Berichte wie "Täuschend echt: KI fälscht Röntgenbilder - selbst Radiologen fallen darauf herein", der Frankfurter Rundschau und anderer Medien.

Für Kranken- und Lebensversicherer bedeuted dies Risiken in Millionenhöhe, da gefälschte Befunde Leistungen auslösen, die medizinisch nicht gerechtfertigt sind. Die klassische manuelle Prüfung durch Sachbearbeiter oder medizinische Experten reicht zunehmend nicht mehr aus.

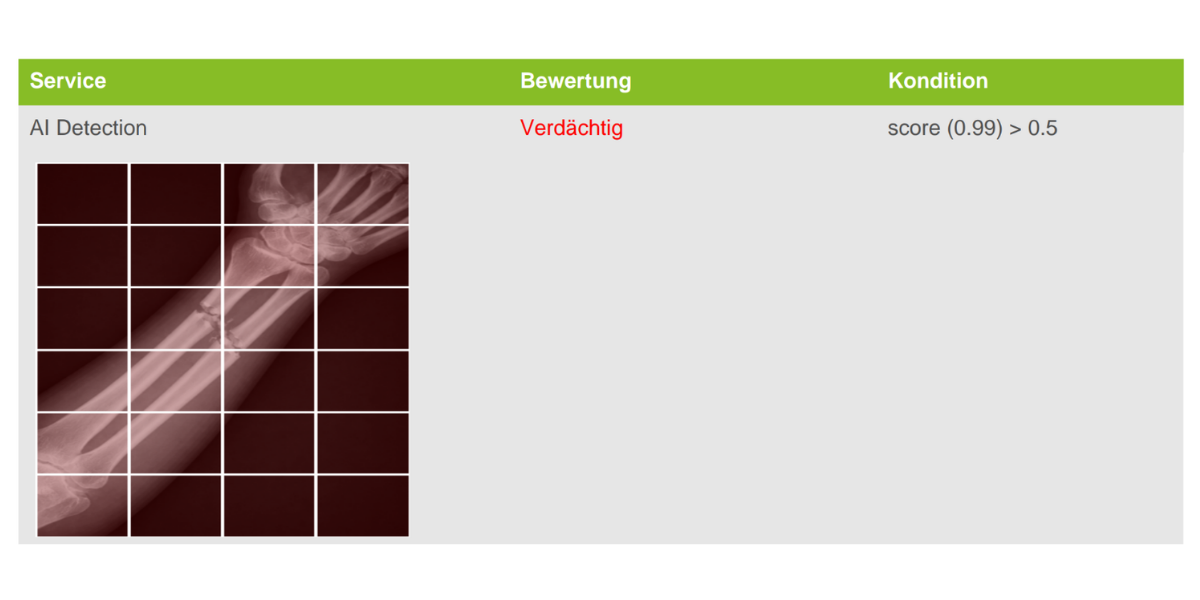

Genau hier setzt fraudify an: Mithilfe spezialisierter Bildforensik werden selbst kleinste Unregelmäßigkeiten in medizinischen Bilddaten zuverlässig erkannt. Wir zeigen wie Versicherer, medizinische Fachkräfte und IT-Sicherheitsverantwortliche, sich so vor manipulierten Röntgenbildern schützen können.

Was sind manipulierte Röntgenbilder?

Manipulierte Röntgenbilder sind medizinische Aufnahmen, die mithilfe von Künstlicher Intelligenz oder Bildbearbeitung gezielt verändert oder vollständig neu erzeugt werden. Ziel ist es meist, Krankheiten vorzutäuschen oder zu verschleiern, um finanzielle Vorteile zu erlangen. Durch den rasanten Fortschritt der KI lassen sich heute Bilder erzeugen oder verändern, die von Originalaufnahmen kaum zu unterscheiden sind. Was als „Deepfake“ in sozialen Netzwerken begann, hat längst kritische Bereiche erreicht. Versicherungen stehen deshalb vor einer neuen Dimension des Abrechnungsbetrugs.

Können erfahrene Radiologen Deepfake MRT- & Röntgenbilder erkennen?

Hervorgebracht wurde die Relevanz durch eine im Fachjournal Radiology veröffentlichte Studie (Tordjman, Yuce et al.). Diese zeigt eindrücklich, wie realistisch KI-generierte Röntgenbilder inzwischen sind, weshalb auch das deutsche Ärzteblatt warnt:

Täuschend echte Bilder: Moderne KI-Modelle erzeugen anatomisch plausible Aufnahmen, die kaum von echten zu unterscheiden sind.

Unsicherheit bei Fachärzten: In einer Untersuchung mit 17 Radiologen aus sechs Ländern wurden nur 41 % der KI-Bilder spontan als Fälschung erkannt – sofern nicht vorab darauf hingewiesen wurde.

Erfahrung schützt nicht: Die Berufserfahrung hatte keinen signifikanten Einfluss auf die Erkennungsrate.

Niedrige Einstiegshürden: Täuschend echte Bilder lassen sich heute per einfacher Texteingabe generieren – ohne Spezialkenntnisse.

Wie gut sind klassische KI Systeme?

Besonders brisant: Selbst die KI-Systeme, die solche Bilder erzeugen, erkennen ihre eigenen Fälschungen nicht zuverlässig. In der Studie identifizierte das verwendete Modell nur etwa 85 % seiner eigenen generierten Inhalte korrekt. Weder klassische KI-Modelle noch erfahrene Ärzte können dieser Herausforderung allein begegnen. Absolute Sicherheit gibt es deshalb nur mit spezialisierten Bildforensik Systemen wie fraudify.

Gibt es typische Indizien für gefälschte Röntgenbilder?

Typische Merkmale von Deepfake Röntgenbildern sind übermäßig glatte Knochen und unnatürlich gerade Wirbelsäulen. Dennoch: die Qualität der künstlichen Bilder nimmt stetig zu, unabhängig von der Körperregion, was die Erkennung erschwert. Die nicht erkennbaren Deepfake-Röntgenbilder gefährden die Diagnosesicherheit, untergraben das Vertrauen in digitale Patientenakten und werden für perfiden Versicherungsbetrug genutzt.

Exkurs: Können manipulierte radiologische Bilder eine Gefahr für die Cybersecurity von medizinischen Einrichtungen darstellen?

Neben dem klassischen Abrechnungsbetrug entsteht eine weitere, oft unterschätzte Gefahr: gezielte Cyberangriffe auf Krankenhäuser durch manipulierte radiologische Bilddaten. Angreifer könnten beispielsweise in klinische Systeme eindringen und Röntgen-, MRT- oder CT-Bilder so verändern, dass Fehldiagnosen begünstigt oder Behandlungen bewusst fehlgeleitet werden.

Zudem sind Ärzte gesetzlich verpflichtet, eine Behandlungsakte wahrheitsgemäß zu führen; Manipulationen verletzen diese Pflicht und können bei Haftungsprozessen zu Beweislasterleichterungen führen.

Zwar heißt es in einem Beitrag der Ärzte Zeitung aus dem Jahr 2018, dass solche Angriffe als unwahrscheinlich gelten, die Perfektion welche KI-generierte Bilder unterdessen erreicht haben zeigt, dass diese Gefahr heute durchaus real ist. Experten warnen vor immer professionelleren Methoden, die gezielt menschliche Schwachstellen in Organisationen ausnutzen.

Die Identifizierung manipulierter Röntgenbilder stellt deshalb eine wachsende Herausforderung für die Cybersicherheit im Gesundheitswesen und der Medizin dar.

Abrechnungsbetrug, wie groß ist das Problem?

Abrechnungsbetrug verursacht in der gesetzlichen Kranken- und Pflegeversicherung zunehmend hohe Schäden, wie der GKV Spitzenverband berichtet. Nach einem Rückgang zu Beginn der Pandemie sind die Fallzahlen und Schadenssummen zuletzt deutlich gestiegen: In den Jahren 2022 und 2023 entstand ein Schaden von über 200 Millionen Euro (zuvor 132 Millionen Euro in 2020/2021). Gleichzeitig nahm die Zahl der Hinweise auf mögliche Betrugsfälle um rund 21 % zu. Positiv ist jedoch, dass knapp die Hälfte der offenen Forderungen – rund 92 Millionen Euro – gesichert werden konnte.

Experten gehen dennoch von einer hohen Dunkelziffer aus. Abrechnungsbetrug entzieht dem Gesundheitssystem erhebliche Mittel, die eigentlich für die Versorgung von Patientinnen und Patienten benötigt werden.

Um diese Entwicklung einzudämmen, wird der Einsatz von Künstlicher Intelligenz (KI) als entscheidender Hebel gesehen. Unser Ziel: Betrugsstrukturen frühzeitig erkennen, Schäden reduzieren und die Solidargemeinschaft der Beitragszahlenden besser schützen.

Warum sind Kranken- und Lebensversicherer jetzt einem besonderen Risiko ausgesetzt?

Die Manipulation medizinischer Bilddaten ist kein theoretisches Problem, sondern eine direkte Bedrohung für die wirtschaftliche Stabilität von Versicherern.

In der Krankenversicherung:

Abrechnung nicht notwendiger Behandlungen

Kettenreaktionen durch Folgeabrechnungen auf Basis eines einzigen gefälschten Bildes

In der Lebens- und Berufsunfähigkeitsversicherung:

Unberechtigte Rentenzahlungen über Jahrzehnte

Hohe Einmalzahlungen durch fingierte schwere Erkrankungen

Werden solche Manipulationen nicht erkannt, führt das zu erheblichen finanziellen Fehlallokationen und gefährdet langfristig die Wettbewerbsfähigkeit.

Welche Rolle spielen manipulierte oder gefälschte Dokumente?

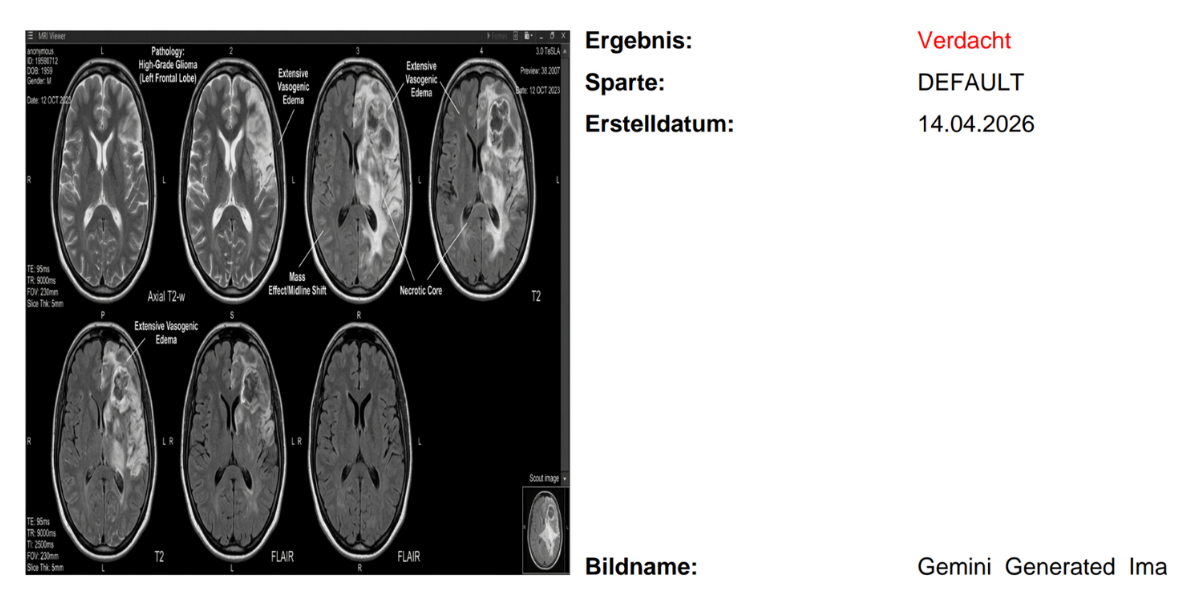

Die Manipulation endet selten beim Bild allein. Häufig handelt es sich um ein orchestriertes Zusammenspiel mehrerer gefälschter Elemente. Moderne Sprachmodelle ermöglichen es, auch begleitende Dokumente täuschend echt zu erstellen:

Medizinisch plausible Befunde: Diagnosen passen exakt zu den manipulierten Bildern und imitieren den Stil erfahrener Fachärzte.

Formale Perfektion: Briefköpfe, Stempel und Unterschriften wirken authentisch und bestehen visuelle Prüfungen.

Skalierbarkeit: Betrug kann automatisiert und in großem Umfang durchgeführt werden.

Wie können sich Versicherer vor KI-generierten Bildern und gefälschten Dokumenten schützen?

Eines ist klar: Die Integrität medizinischer Bilddaten ist nicht länger selbstverständlich. Mit der zunehmenden Verbreitung leistungsfähiger KI wächst auch das Risiko systematischen Abrechnungsbetrugs.

Für Versicherer bedeutet das: Der Einsatz einer spezialisierten Bildforensik Software ist kein optionales Upgrade mehr, sondern eine notwendige Voraussetzung für wirksames Betrugsmanagement.

fraudify bietet hierfür einen mehrschichtigen Ansatz:

Bildforensische Analyse: Untersuchung bis auf Pixelebene, um selbst feinste Manipulationen sichtbar zu machen

Deepfake-Erkennung: Identifikation typischer KI-Artefakte und struktureller Unstimmigkeiten

Metadaten-Prüfung: Analyse von Zeitstempeln, Geräteinformationen und Bearbeitungsspuren

Rückwärtssuche im Internet: Aufdeckung mehrfach verwendeter oder aus dem Kontext gerissener Bilder

Doubletten-Erkennung: Identifikation ähnlicher oder modifizierter Bilder über verschiedene Fälle hinweg

Dokumenten-Forensik: Optionale Integration einer Dokumentforensik durch ein Partnerunternehmen

Sprich mit uns: Erfahre, wie fraudify Prozesse optimiert, Risiken reduziert und Betrugsversuche frühzeitig aufdeckt. Gerne demonstrieren wir, wie eine Integration in bestehende Prüfstrecken konkret aussehen kann.

FAQ – Häufig gestellte Fragen zu manipulierten Röntgenbildern

Manipulierte Röntgenbilder sind medizinische Aufnahmen, die mithilfe von Künstlicher Intelligenz oder Bildbearbeitung gezielt verändert oder vollständig neu erzeugt werden. Ziel ist es meist, Krankheiten vorzutäuschen oder zu verschleiern, um finanzielle Vorteile zu erlangen.

Moderne KI-Systeme können heute täuschend echte medizinische Bilder generieren. Diese sind oft so realistisch, dass selbst Fachärzte Schwierigkeiten haben, sie von echten Aufnahmen zu unterscheiden. Dadurch steigt das Risiko für systematischen Betrug erheblich.

Nein, nicht immer. Studien zeigen, dass selbst erfahrene Radiologen KI-generierte Bilder häufig nicht sicher identifizieren können. Erfahrung allein reicht daher nicht mehr aus, um Manipulationen zuverlässig aufzudecken.

KI erleichtert sowohl die Erstellung gefälschter Bilder als auch die Generierung passender Dokumente wie Arztberichte oder Rechnungen. Dadurch entstehen immer komplexere und schwerer erkennbare Betrugsmuster.

Teilweise ja – etwa unnatürlich glatte Strukturen oder anatomische Unstimmigkeiten. Allerdings werden diese Merkmale durch immer bessere KI-Modelle zunehmend reduziert, sodass sie oft nicht mehr sichtbar sind.

Allein in der gesetzlichen Kranken- und Pflegeversicherung entstehen Schäden in dreistelliger Millionenhöhe. Experten gehen zusätzlich von einer hohen Dunkelziffer aus.

Ja. Neben Betrugsszenarien sind auch gezielte Cyberangriffe denkbar, bei denen medizinische Bilddaten manipuliert werden, um Diagnosen oder Behandlungen zu beeinflussen.

Der effektivste Schutz liegt im Einsatz spezialisierter Technologien. Bildforensik-Lösungen wie fraudify analysieren medizinische Bilder automatisiert und erkennen selbst kleinste Manipulationen, die für Menschen unsichtbar bleiben.

Die Qualität KI-generierter Inhalte ist mittlerweile so hoch, dass visuelle Prüfungen allein nicht mehr zuverlässig sind. Automatisierte, datenbasierte Analysen sind notwendig, um Betrug frühzeitig zu erkennen.

fraudify kombiniert verschiedene Prüfverfahren wie Pixelanalyse, Deepfake-Erkennung, Metadaten-Checks und Internet-Rückwärtssuche. Dadurch lassen sich manipulierte Bilder und zusammenhängende Betrugsmuster frühzeitig identifizieren und stoppen.