Gefahren durch Bildmanipulation und wie fraudify manipulierte Bilder erkennt.

Bildmanipulation war noch nie so einfach wie heute. Mit nur wenigen Klicks lassen sich aus gewöhnlichen Fotos täuschend echte Fälschungen machen – mal zum Spaß, mal aus bitterem Ernst. Häufig steckt hinter der Bearbeitung eine klare Absicht, etwa um gezielt zu täuschen oder bestimmte Reaktionen hervorzurufen. Während KI-Filter und Photoshop-Tricks in sozialen Medien für Unterhaltung sorgen, nutzen andere dieselben Techniken für gezielte Täuschung: Fake-News, Identitätsbetrug oder gefälschte Beweise sind längst keine Seltenheit mehr. Doch wie kann man echte Bilder von manipulierten unterscheiden?

In diesem Beitrag werfen wir einen Blick auf das Thema Bildmanipulation: Welche Methoden gibt es? Woran erkennst Du manipulierte Bilder? Und wie kann moderne Technologie Dir dabei helfen, Fälschungen zuverlässig zu entlarven? Anhand praktischer Beispiele zeigen wir, wie unsere Bildforensik-Lösung fraudify selbst versteckte Manipulationen sichtbar macht – von einfachen Retuschen bis hin zu komplexen Deepfakes.

Was ist eine Bildmanipulation - Definition

Bildmanipulation meint die gezielte Veränderung eines Fotos, um eine andere Wirklichkeit vorzutäuschen – also etwas zu zeigen, das so nie existiert hat. Mit technischen Mitteln lässt sich ein Bild heute nahezu beliebig formen, verschönern oder verfälschen.

Die Fotografie bildet dabei die Grundlage für viele Manipulationen, da sowohl bei der Aufnahme als auch bei der späteren Bearbeitung gezielt in das Bild eingegriffen werden kann.

Manipulation kann in allen Phasen der Bildentstehung stattfinden:

Vor der Aufnahme wird das Bild inszeniert – Objekte, Menschen oder ganze Szenen werden bewusst arrangiert, um eine bestimmte Wirkung zu erzielen.

Während der Aufnahme kommen Techniken wie die Mehrfachbelichtung zum Einsatz, um das Bild schon im Moment der Entstehung zu beeinflussen.

Nach der Aufnahme beginnt die eigentliche Bildbearbeitung. Früher nannte man es Retusche oder Montage – heute sind es Filter, KI-basierte Tools und digitale Retuschen, die Bilder glätten, verändern oder komplett neu zusammensetzen.

Was dabei herauskommt, ist oft kein Dokument der Realität mehr, sondern eine gezielte Konstruktion. In Zeiten von Social Media, Werbung und KI-Bildern wird die Grenze zwischen echtem Foto und perfekter Illusion zunehmend unscharf – und genau deshalb sollten wir lernen, Bilder wieder kritisch zu betrachten.

Welche Arten von Bildmanipulation gibt es?

Bildmanipulation ist nicht gleich Bildmanipulation. Zwischen einem harmlosen Filter und einem täuschend echten Deepfake liegt eine breite Palette an Techniken, die sich grob in drei Kategorien einteilen lassen: Durch verschiedene Effekte, wie technische Filter oder perspektivische Veränderungen, können Bilder gezielt bearbeitet werden, um bestimmte visuelle Wirkungen oder kreative Ergebnisse zu erzielen.

1. Retusche und kosmetische Eingriffe

Hierzu zählen klassische Bildbearbeitungen wie das Entfernen von Hautunreinheiten, das Glätten von Falten oder das Aufhellen von Farben. Solche Bearbeitungen werden nicht nur bei Bildern, sondern auch zur Manipulation von Dokumenten eingesetzt, um deren Authentizität zu beeinflussen. Solche Eingriffe wirken oft harmlos, können aber je nach Kontext eine irreführende Wirkung haben – etwa in der Werbung oder bei politischen Darstellungen.

2. Bildmontage und Compositing

In dieser Stufe werden mehrere Bildelemente zu einem neuen Ganzen zusammengesetzt. Bei einer Fotomontage können verschiedene Teile eines Bildes oder sogar der Kopf einer Person gezielt in einen anderen Bereich des Bildes eingefügt werden. Fotomontagen dienen häufig dazu, Objekte zu entfernen oder hinzuzufügen, um die Authentizität des Bildes zu verändern.

Einzelne Bereiche eines Bildes werden dabei manipuliert, um bestimmte Informationen zu verbergen oder hervorzuheben. Ein Gesicht wird auf einen anderen Körper montiert, Objekte werden entfernt oder hinzugefügt. Mit steigender Qualität der Werkzeuge (z. B. Adobe Photoshop und/oder KI-gestützte Editoren) werden diese Manipulationen immer schwerer zu erkennen.

3. Deepfakes und generative KI

Die neueste Stufe der Bildfälschung basiert auf Künstlicher Intelligenz. Deepfake-Technologien können Gesichter, Stimmen und sogar Bewegungen täuschend echt imitieren. Dabei ist es möglich, das Originalfoto einer Person durch ein manipuliertes Bild zu ersetzen, sodass die Identität oder das Aussehen der Person gezielt verändert wird.

Mit Hilfe von KI können nicht nur einzelne Personen, sondern auch komplette Hintergründe oder mehrere Personen in einem Bild verändert oder neu generiert werden, wodurch kreative Bearbeitungen und visuelle Anpassungen erleichtert werden.

Der Interpretationsansatz bei der Bearbeitung von Bildern durch KI ermöglicht es, gezielt eine bestimmte Botschaft, Meinung oder ästhetische Wirkung zu vermitteln, anstatt nur die Realität abzubilden. Journalisten spielen eine entscheidende Rolle bei der Aufdeckung und transparenten Berichterstattung über Deepfakes und Bildmanipulationen, um die Öffentlichkeit über mögliche Manipulationen zu informieren.

Gefahren durch Bildmanipulationen

Verfahren zur Manipulation medialer Identitäten gibt es schon seit vielen Jahren. Auch dass Bilder sich auf unterschiedlichste Weise verändern lassen, ist längst bekannt. Doch während es früher äußerst aufwendig war, dynamische Medien wie Videos oder Tonaufnahmen realistisch zu fälschen, hat sich das mit dem Einsatz Künstlicher Intelligenz grundlegend verändert: Heute lassen sich selbst hochwertige Fälschungen mit relativ geringem Aufwand und ohne tiefgehende Fachkenntnisse erzeugen. Dies birgt ein erhebliches Risiko für Unternehmen und Privatpersonen, da manipulierte Medien zu Datenschutzproblemen, rechtlichen Konsequenzen und Vertrauensverlust führen können.

Betrugsversuche durch Deepfakes

Moderne KI-Technologien zur Bildmanipulation eröffnen nicht nur neue kreative Möglichkeiten – sie werden zunehmend auch für betrügerische Zwecke missbraucht. Ein bekannter Fall ist etwa die Verbreitung eines Deepfake-Videos, in dem eine prominente Persönlichkeit scheinbar politische Aussagen trifft, die sie nie getätigt hat, um gezielt die öffentliche Meinung zu beeinflussen. Ob zur Täuschung in sozialen Medien, zur Erstellung gefälschter Beweisvideos oder zur Verschleierung von Identitäten: Die Verfahren ermöglichen es, visuell überzeugende Fälschungen zu erzeugen, die selbst für geschulte Augen nur schwer zu entlarven sind. Besonders perfide ist der Einsatz in sogenannten Deepfake-Betrugsszenarien, bei denen manipulierte Videos oder Bilder gezielt eingesetzt werden, um Vertrauen zu erschleichen, Identitäten zu fälschen oder Desinformation zu verbreiten.

Beispiel 1: Deepfake CFO-Scam in Hongkong

Ein besonders eindrückliches Beispiel für den Missbrauch solcher Technologien spielte sich Anfang 2024 in Hongkong ab: Eine Angestellte einer multinationalen Firma wurde durch eine täuschend echt wirkende Video-Konferenz dazu gebracht, rund 25 Millionen US-Dollar an Betrüger zu überweisen. Die Betrüger nutzten KI-generierte Deepfakes, um den CFO und weitere Führungskräfte der Firma visuell sowie akustisch zu imitieren. Alle Beteiligten wirkten so authentisch, dass die Angestellte – trotz anfänglicher Skepsis gegenüber einer ungewöhnlichen E-Mail – letztlich den Anweisungen folgte

Dieses Beispiel lässt keinen Zweifel daran, wie notwendig umfassende Schutzmaßnahmen gegen Deepfake-basierte Betrugsversuche sind. Wenn selbst erfahrene Mitarbeiter in einem professionellen Umfeld durch realistisch wirkende Video-Deepfakes getäuscht werden können, reicht menschliches Urteilsvermögen allein nicht mehr aus.

Unternehmen müssen verstärkt in technische Lösungen wie Bild- und Video-Forensik investieren, um die Authentizität visueller Inhalte verlässlich prüfen zu können. Auch Sensibilisierung und Schulungen zum Umgang mit KI-Fälschungen sollten Teil jeder Sicherheitsstrategie sein – denn die nächste Deepfake-Attacke ist keine Frage des Ob, sondern des Wann.

Beispiel 2: Deepfakes im Wahlkampf

Ein weiteres alarmierendes Beispiel, über das der Stern berichtet, stammt aus dem deutschen Wahlkampf: Im Januar 2025 sorgte ein manipuliertes Video für Aufsehen, in dem Bundeskanzler Olaf Scholz scheinbar einen Salto über das Rednerpult im Bundestag macht – natürlich ein Deepfake.

Noch gravierender: Noch im November 2024 postete der SPD-Abgeordnete Bengt Bergt ein KI-generiertes Video, in dem CDU-Kanzlerkandidat Friedrich Merz angeblich erklärt: „Wir verachten Sie! Und wir verachten die Demokratie.“ Obwohl Merz dies niemals gesagt hat, sorgte das Video für Empörung, eine Entschuldigungspflicht von Bergt – und zeigte eindrücklich, wie solche Inhalte gezielt zur Destabilisierung des öffentlichen Diskurses eingesetzt werden.

Mit der rasanten Entwicklung KI-basierter Bild- und Videomanipulationen wird es für Redaktionen, Faktenchecker und Plattformbetreiber immer schwieriger, echte Inhalte von Fälschungen zu unterscheiden. Was früher mit geübtem Auge oder einfacher Software überprüfbar war, erfordert heute spezialisierte forensische Analyseverfahren. Täuschend echt wirkende Deepfakes lassen sich oft nicht mehr auf den ersten Blick entlarven – insbesondere dann, wenn Ton, Bild und Kontext scheinbar stimmig zusammenspielen.

Betrugsversuche durch Bildmontagen und Generative KI

Täuschend echte Bilder waren lange eine Domäne professioneller Bildbearbeitung – doch mit dem Aufkommen generativer KI hat sich das grundlegend geändert. Heute lassen sich in Sekunden täuschend realistische Fotos und Bildmanipulationen erzeugen – ganz ohne grafisches Know-how. Was harmlos als kreatives Spiel beginnt, kann schnell zur ernsten Bedrohung werden.

Beispiel 3: Versicherungsbetrug durch manipulierte Schadenbilder

Mit dem Vormarsch digitaler Tools eröffnen sich nicht nur neue Chancen, sondern auch neue Schlupflöcher für Betrugsversuche. Besonders im Versicherungswesen wird das deutlich: Laut dem Gesamtverband der Deutschen Versicherungswirtschaft (GDV) enthält etwa jede zehnte Schadensmeldung Unstimmigkeiten. Immer häufiger manipulieren Betrüger die bei der Schadensmeldung eingereichten Fotos – etwa durch digitale Retuschen oder KI-generierte Bilder – so geschickt, dass die Fälschung mit bloßem Auge kaum zu erkennen ist. Die nötigen Werkzeuge sind günstig, leicht verfügbar und erfordern kaum technisches Know-how.

Stell Dir vor, jemand will bei seiner Versicherung einen kleinen Schaden melden – zum Beispiel eine zerkratzte Stoßstange. Doch anstatt das echte Foto einzureichen, bearbeitet er das Bild digital so, dass es aussieht, als wäre der gesamte Kotflügel eingedellt oder das Fahrzeug schwer beschädigt. Mit nur wenigen Klicks wird aus einem harmlosen Kratzer ein kostspieliger Unfallschaden. Solche Bildmanipulationen wirken auf den ersten Blick glaubwürdig – und genau hier wird Bildforensik entscheidend, um Fälschungen sichtbar zu machen und Betrug rechtzeitig zu erkennen.

Alarmierend ist auch, dass laut GDV bereits 16 % der Täter vor ihrer Tat gezielt Online-Foren und Netzwerke nutzen, um sich über Methoden und Tricks zu informieren. Die Folge: Der Aufwand für eine fundierte Bildprüfung steigt – und der Bedarf an forensischen Analysewerkzeugen wächst.

Dieses Bild wurde manipuliert.

Auch dieser Schaden wurde fingiert.

fraudify warnt vor manipulierten Bildbereichen.

Vieles deutet auf Manipulationen hin.

Kann eine Bildforensik wie fraudify Betrug durch Bildmanipulation stoppen?

Angesichts der zunehmenden Verbreitung digitaler Bildfälschungen wird es immer wichtiger, Manipulationen frühzeitig zu erkennen – bevor daraus ein finanzieller oder reputativer Schaden entsteht. Mit unserer Lösung fraudify bieten wir ein leistungsstarkes Werkzeug zur Bildforensik, das genau hier ansetzt: Es analysiert eingereichte Bilder auf verdächtige Veränderungen, erkennt Spuren von Retusche, Montage oder KI-generierter Manipulation und liefert nachvollziehbare Hinweise auf potenziellen Betrug. So verwandeln wir Unsicherheit in überprüfbare Fakten – und schaffen eine verlässliche Grundlage für Entscheidungen.

Wie funktioniert eine Bildforensik?

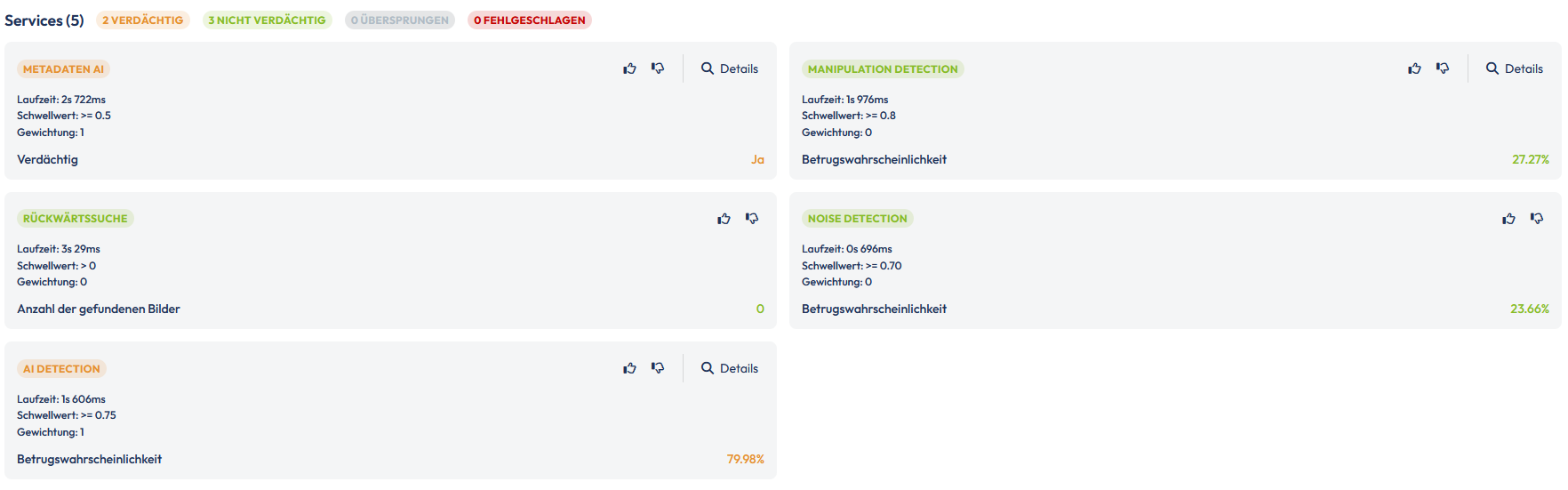

Um Bildmanipulationen effektiv aufzudecken, setzt fraudify auf verschiedene forensische Verfahren, die unterschiedliche Spuren und Unregelmäßigkeiten im Bild analysieren.

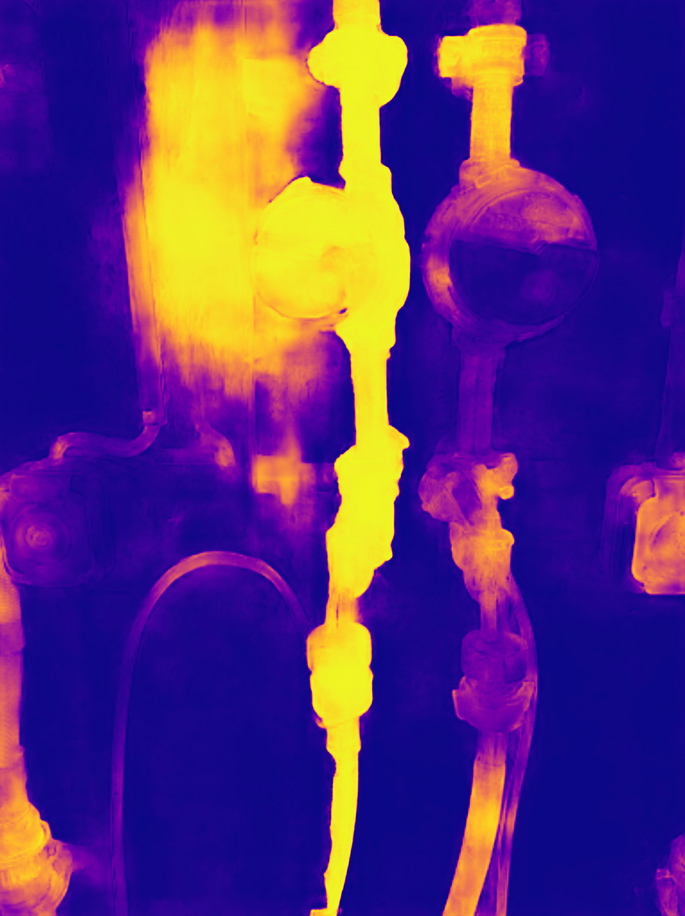

Rauschkontrolle: Unregelmäßigkeiten entlarven

Wenn Du ein digitales Bild aufnimmst, entsteht dabei immer ein gewisses Maß an sogenanntem Bildrauschen – das sind feine Helligkeits- oder Farbschwankungen, ähnlich wie die Körnung auf analogen Filmfotos, die bei schwachem Licht aufgenommen wurden. Dieses Rauschen verteilt sich normalerweise gleichmäßig über das gesamte Bild. Wird ein Bild jedoch im Nachhinein verändert – etwa durch das Einfügen neuer Elemente, kann es zu Unregelmäßigkeiten im Rauschmuster kommen. Genau hier setzt die Rauschkontrolle an: Sie prüft, ob bestimmte Bereiche aus dem Rahmen fallen. Weichen einzelne Bildabschnitte in ihrem Rauschen deutlich vom Rest ab, ist das ein starker Hinweis auf mögliche Manipulation – und ein wertvoller Anhaltspunkt für die Bildforensik.

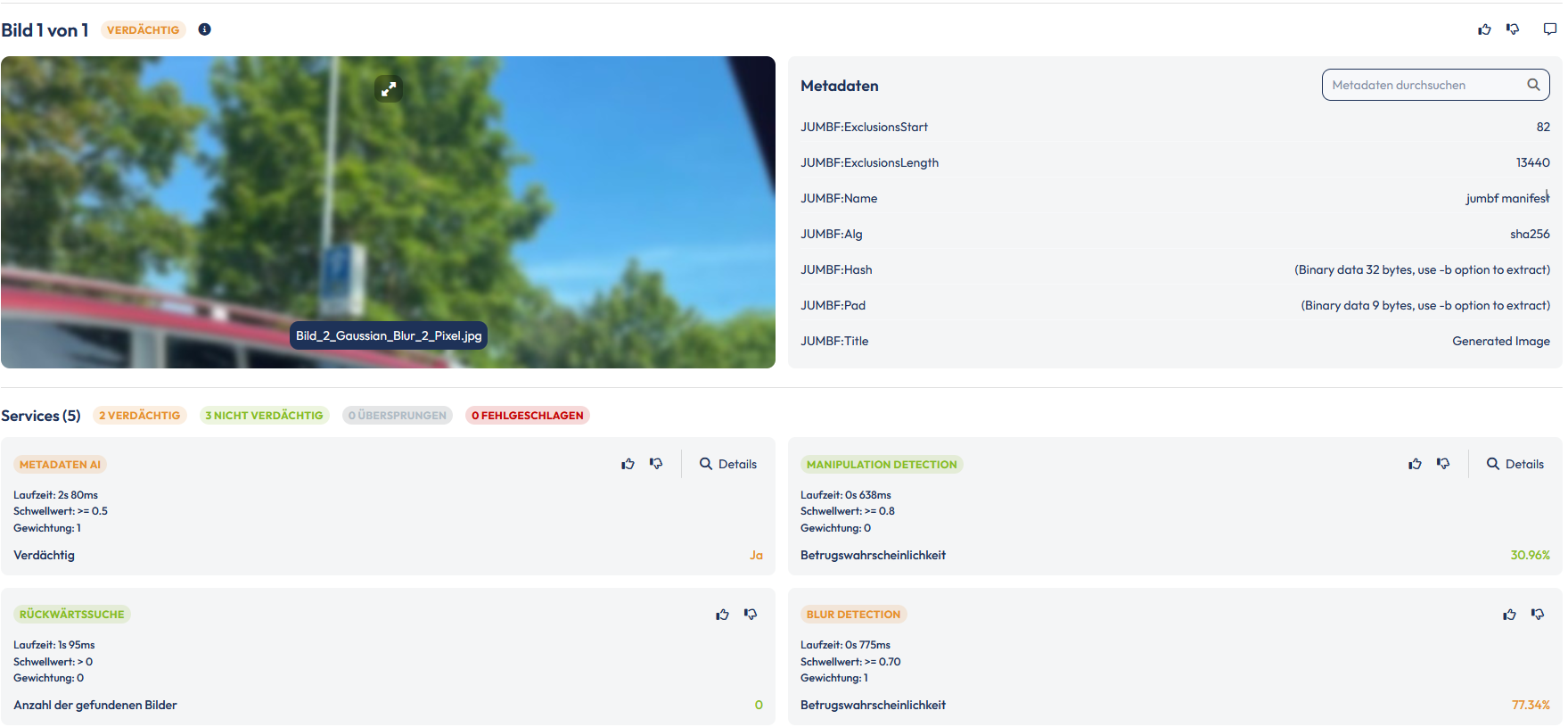

Metadaten-Analyse: Versteckte Hinweise untersuchen

Digitale Bilder enthalten in der Regel Informationen, sogenannte Metadaten, die Details wie Kameraeinstellungen, Aufnahmezeitpunkt oder den Ort der Aufnahme speichern. Man kann sie sich wie eine Art digitale „Begleitdokumentation“ zum Bild vorstellen.

Unsere Metadaten-Analyse überprüft diese Informationen auf Auffälligkeiten. Zum Beispiel könnte ein mithilfe von KI-generiertes Bild einen Eintrag in den Metadaten haben, der Rückschlüsse auf die Verwendung der Software erlaubt – ein klarer Hinweis darauf, dass etwas nicht stimmt. Auch fehlende oder nachträglich veränderte Metadaten geben wichtige Hinweise auf mögliche Bildmanipulationen. So hilft die Analyse, mögliche Bearbeitungen schon anhand der Bildinformationen zu erkennen – noch bevor man sich das Bild selbst genauer anschaut.

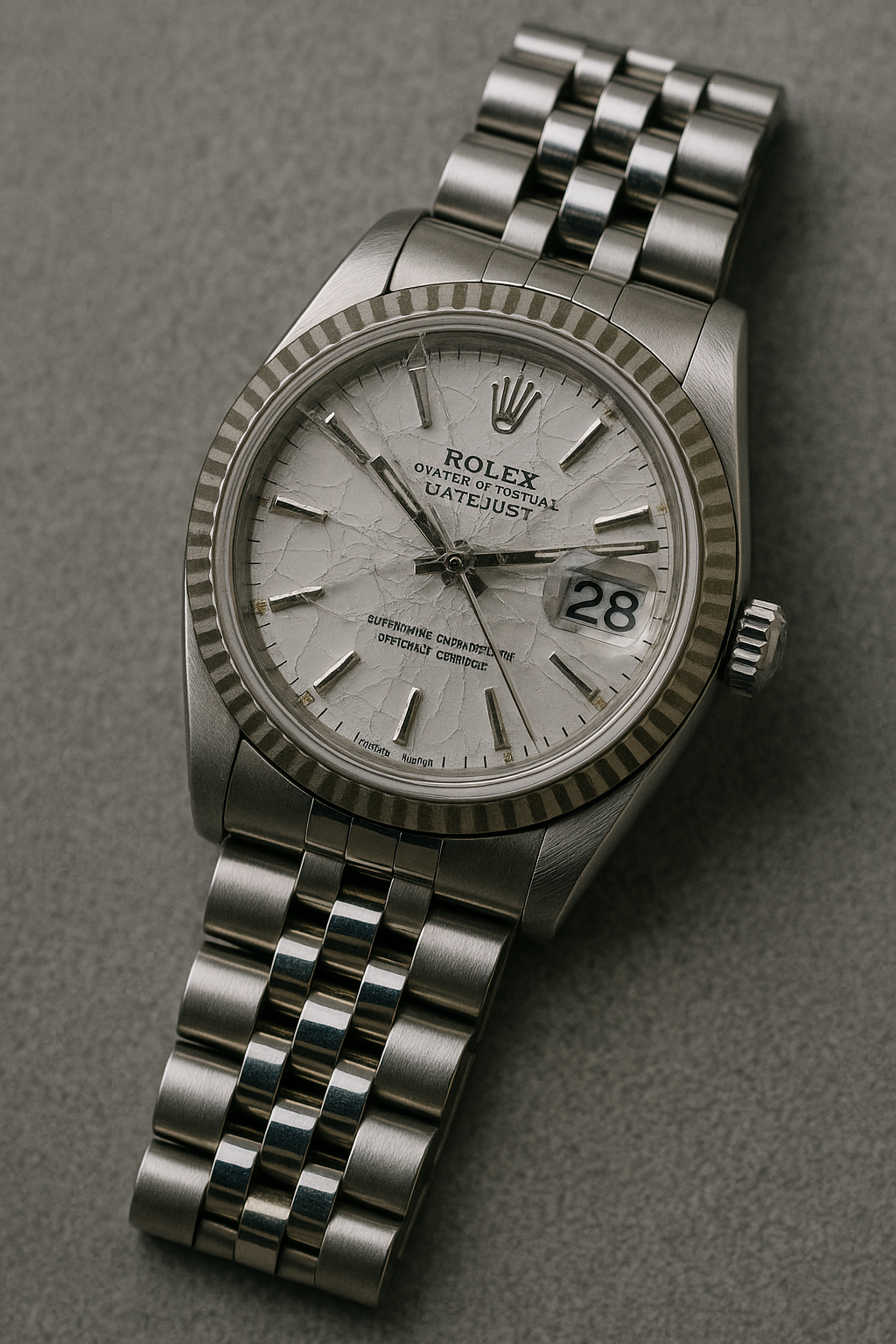

Ist diese Uhr wirklich defekt?

Unstimmigkeiten in den Metadaten deuten auf Manipulation hin.

Image Splicing Erkennung: Erkennung von Bildmontagen

Bei Bildmanipulation durch sogenanntes Splicing – werden mehrere Bildteile aus unterschiedlichen Quellen zu einem neuen, scheinbar stimmigen Gesamtbild zusammengesetzt. Für das ungeübte Auge wirkt das Ergebnis oft glaubwürdig, doch unsere Splicing-Erkennung deckt genau solche Täuschungen auf. Unstimmige Übergänge zwischen einzelnen Bildbereichen können ein deutliches Anzeichen dafür sein, dass das Bild aus verschiedenen Quellen zusammengesetzt wurde. Diese Technik ist besonders hilfreich, um komplexe Bildmontagen zu identifizieren – etwa bei gefälschten Schadenfotos oder manipulierten Nachweisen in betrügerischen Dokumenten.

Schwer zu sagen, ob dieses Bild manipuliert wurde.

fraudify erkennt den hinzugefügten Wasserzähler.

Blurr Detection: verschwommene Bereiche erkennen

In der Bildforensik bezeichnet Blurr Detection die automatisierte Erkennung von Unschärfe in digitalen Bildern, um Manipulationen aufzudecken oder die Bildqualität zu bewerten. Unschärfe kann bewusst eingesetzt werden, um Details zu verschleiern, z. B. bei der Retusche von Gesichtern oder Objekten. Durch Analyse von Kanten, Frequenzanteilen oder mittels Methoden wie der Laplacian-Varianz lässt sich feststellen, ob und wo im Bild Unschärfe vorliegt. Auffällige Unschärfeunterschiede zwischen Bildbereichen können auf nachträgliche Bearbeitungen und somit auf mögliche Fälschungen hinweisen.

Originalbild

Bild mit Weichzeichner

fraudify erkennt Weichzeichner

Fazit: fraudify als Schlüssel im Kampf gegen Bildmanipulation

In einer Zeit, in der manipulierte Bilder und KI-generierte Inhalte immer überzeugender und leichter zu erstellen sind, braucht es verlässliche Methoden zur Aufdeckung solcher Täuschungen. Unsere Lösung fraudify liefert genau das: eine leistungsstarke, automatisierte Bildforensik, die Manipulationen sichtbar macht, nachvollziehbare Analysen ermöglicht und so fundierte Entscheidungen unterstützt.

Ob im Versicherungswesen, in der Medienbranche oder bei Ermittlungsbehörden – fraudify ist das Mittel der Wahl, wenn es darum geht, bildbasierten Betrugsversuchen wirksam entgegenzutreten und Bildmanipulationen aufzudecken. Sprich mit uns und gib Betrügern keine Chance – wir zeigen Dir in einer Live-Demo, wie fraudify arbeitet!

FAQ - Wieso sind Bildmanipulationen so gefährlich?

Bildmanipulation bedeutet jede gezielte Veränderung eines Fotos, um eine andere Wirklichkeit vorzutäuschen – etwa durch Retusche, Montage, Filter oder generative KI. Bereits das Arrangieren von Szenen vor der Aufnahme oder Mehrfachbelichtungen währenddessen kann Teil sein. Nachbearbeitung umfasst das Verändern von Farben, Entfernen oder Hinzufügen von Objekten, aber auch ausgefeilte Deepfake-Techniken.

Man kann drei Hauptkategorien unterscheiden:

Retusche und kosmetische Eingriffe: Glätten von Haut, Entfernen von Unreinheiten, Farbkorrekturen usw.

Bildmontage / Compositing: Zusammensetzen von Bildelementen aus verschiedenen Quellen, Einfügen oder Entfernen von Objekten, Veränderung von Hintergründen.

Deepfakes und generative KI: KI-Systeme, die Gesichter, Stimmen oder ganze Szenen täuschend echt imitieren, oder KI-generierte Hintergründe und Personen nutzen.

Mehrere Risiken sind zu beachten:

Vertrauensverlust, wenn manipulierte Bilder publik werden und Glaubwürdigkeit untergraben wird.

Rechtliche Folgen, z. B. bei gefälschten Beweismitteln oder Betrugsfällen.

Missbrauch für Desinformation, Wahlbeeinflussung, Identitätsbetrug oder Versicherungsbetrug.

Datenschutzprobleme, wenn sensible Inhalte verändert oder veröffentlicht werden.

Verschiedene forensische Methoden helfen dabei:

Rauschmuster-Analyse: Überprüfung, ob das Bildrauschen gleichmäßig verteilt ist oder ob auffällige Abweichungen vorhanden sind.

Metadaten-Analyse: Untersuchung von eingebetteten Daten wie Kameraeinstellungen oder Zeitpunkt – unlogische oder fehlende Metadaten können Hinweise auf Manipulation sein.

Splicing-Erkennung: Aufdecken von Übergängen, bei denen Bildteile aus verschiedenen Quellen zusammengesetzt wurden.

Blurr Detection: Analyse von verschwommenen Bereichen, die gezielt verschleiern, z. B. um Details zu verbergen.

Bildforensik bezeichnet Techniken und Technologien, mit denen Fälschungen sichtbar gemacht werden. Dazu gehören:

Automatisierte Prüfverfahren, die Unregelmäßigkeiten entdecken (z. B. Rauschabweichungen, unlogische Metadaten, Splicing-Fehler).

Werkzeuge, die manipulierte Bereiche markieren oder Hinweise liefern, wie „Verdacht auf Retusche“.

Einsatz in Bereichen mit hohem Risiko (Versicherung, Medien, Recht), um Betrug oder Täuschung frühzeitig zu erkennen und Schäden zu begrenzen.

Bildmaterial kritisch prüfen, nicht sofort allem visuellem Eindruck glauben. Details wie Schatten, Proportionen, Lichtverhältnisse hinterfragen.

Nutzung von Forensik-Software oder Tools, die speziell dafür entwickelt sind, Manipulationen zu erkennen.

Schulung von Mitarbeiter:innen, um Sensibilität für Manipulationstechniken zu entwickeln.

Rechtliche Absicherung, z. B. durch vertragliche Vorgaben oder Compliance-Regeln, besonders bei Bild-Content, Schadenmeldungen etc.