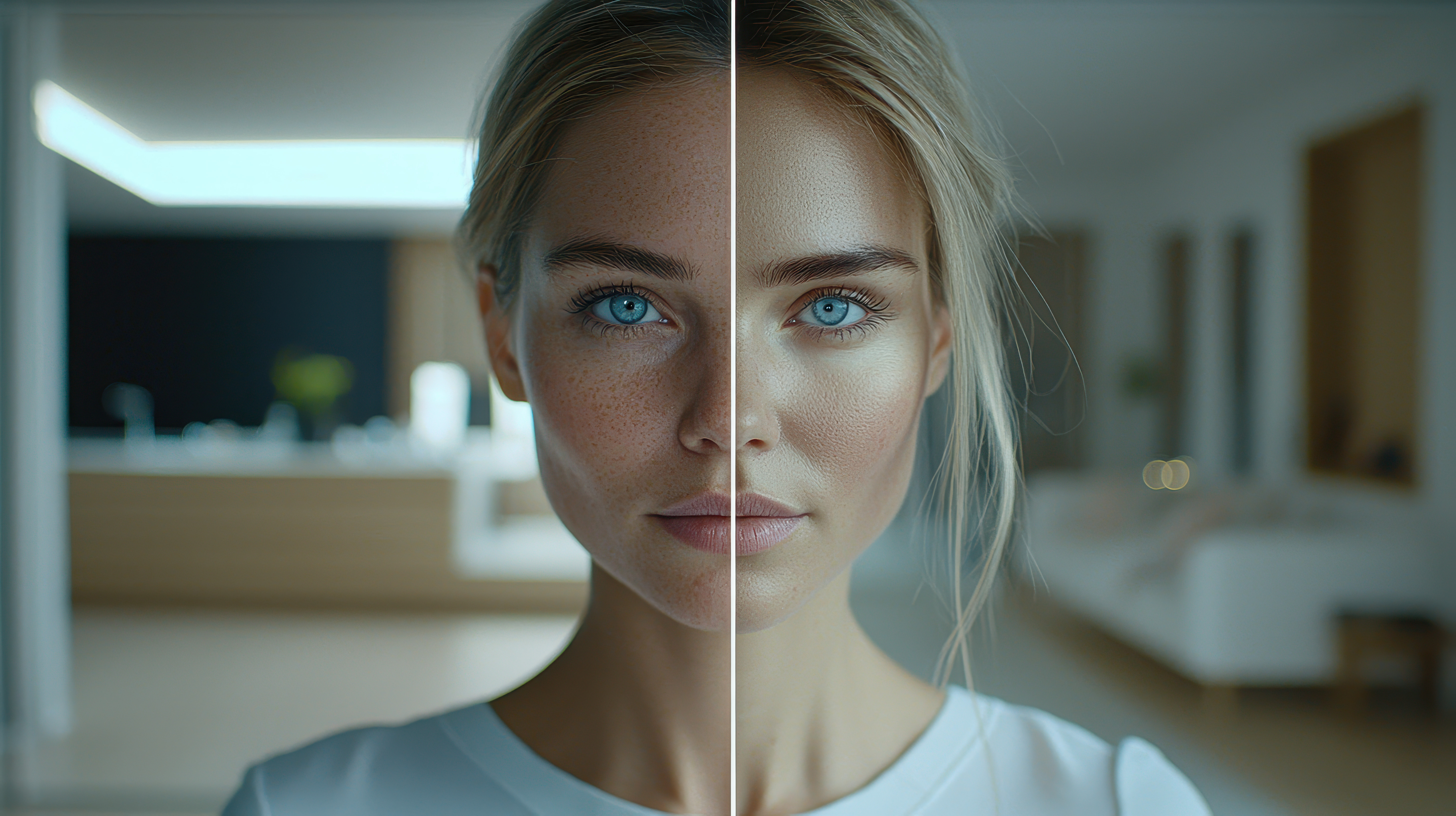

Deep Fakes, Fake News, Was ist noch echt? Wie kann ich Fake Bilder erkennen?

In einer Welt, in der ein Foto nicht mehr zeigt, was wirklich war – sondern das, was jemand Dich glauben lassen will – verschwimmen Realität und Fälschung immer mehr. Gerade durch die gezielte Verbreitung von Fehlinformationen in Form manipulierten Bildmaterials wird die Wahrnehmung der Wahrheit zunehmend erschwert. Fake-Bilder kursieren heute in allen Nachrichten, auf Plattformen und in sozialen Netzwerken und es wird immer schwieriger, in diesem Netz von Informationen die Wahrheit zu erkennen. Mit modernen KI-Tools und Bildbearbeitungsprogrammen lassen sich Bilder heute mit wenigen Klicks manipulieren – und das kann gravierende Folgen haben.

Die Auswirkungen: Fake-Bilder beeinflussen alle Bereiche der digitalen Kommunikation und können das Vertrauen in Medien nachhaltig erschüttern.

Ob gefälschte Schadensbilder bei Versicherungen, KI-generierte Fotos angeblicher Verwandter in perfiden Betrugsmaschen oder täuschend echte Deepfakes in den sozialen Medien – visuelle Manipulation ist längst keine Ausnahme mehr, sondern eine reale Bedrohung. Die Verbreitung von Fake-Bildern auf verschiedenen Plattformen und in Netzwerken untergräbt zunehmend die Glaubwürdigkeit von Nachrichten.

Deshalb stellt sich die Frage: Wie erkennst Du, was echt ist? Und wie kannst Du Dich schützen vor der wachsenden Gefahr gefälschter Bilder? Angesichts der Flut an manipulierten Bildern im Internet wird es immer schwieriger, den Überblick zu behalten und Fälschungen zuverlässig zu erkennen.

In diesem Blogbeitrag erfährst Du, warum Fake-Bilder so gefährlich sind, worauf Du achten solltest – und wie unsere Software Unternehemen dabei hilft, die Wahrheit hinter einem Bild sichtbar zu machen.

Wie kann man erkennen, ob ein Bild manipuliert wurde?

Manipulierte Bilder sind heute ein zentrales Werkzeug moderner Desinformationskampagnen – und leider oft schwer zu erkennen. Manche Fälschungen springen Dir vielleicht sofort ins Auge, andere wirken auf den ersten Blick vollkommen echt. Umso wichtiger ist es, dass Du lernst, auf die feinen Details zu achten, die nicht zusammenpassen.

Die Analyse von Merkmalen wie Mustern, Texturen und Lichtverhältnissen spielt eine entscheidende Rolle bei der Erkennung von Bildmanipulationen, da Unstimmigkeiten in diesen Bereichen häufig auf Fälschungen hinweisen.

Worauf solltest Du bei Bildern besonders achten?

Unstimmige Licht- und Schattenverhältnisse: Schau genau hin! Wirken die Schatten logisch? Kommt das Licht aus einer realistischen Richtung? Achte besonders darauf, ob das Gesicht und dessen Schatten natürlich wirken – unpassende Schatten am Gesicht können ein klares Zeichen für eine Bildbearbeitung sein.

Fehler im Hintergrund: Verzerrte Strukturen, doppelte Objekte oder seltsam verschwommene Bereiche im Hintergrund können Hinweise auf KI-generierte oder nachträglich veränderte Inhalte sein.

Aus dem Kontext gerissene Bilder: Nicht jedes Fake-Bild ist manipuliert – manche Aufnahmen sind echt, erzählen aber eine falsche Geschichte. Bilder von früheren Ereignissen werden häufig als aktuelle Sensationen verbreitet, um gezielt zu täuschen oder Emotionen zu schüren.

Manipulative Zuschnitte: Wird ein Bild stark beschnitten, fehlen womöglich entscheidende Informationen. Ein veränderter Bildausschnitt kann gezielt genutzt werden, um wichtige Details zu verbergen und so eine Täuschung zu erzeugen. Das, was absichtlich weggelassen wird, kann genauso manipulativ sein wie das, was Du siehst.

Auffällige oder fehlerhafte Textfragmente: Achte auf unlogische, falsch geschriebene oder verzerrte Textstellen im Bild. Solche Textfragmente können durch automatische Texterkennung (OCR) identifiziert werden und sind oft ein Hinweis auf Manipulation oder KI-generierte Inhalte.

Auch wenn ein einzelner Hinweis noch keinen Beweis liefert, ergibt sich oft ein klares Gesamtbild, wenn mehrere dieser Warnsignale zusammenkommen. Ein kritischer Blick auf Licht, Perspektive, Details, Text und Kontext kann Dir helfen, viele Fakes zu entlarven – oder zumindest berechtigte Zweifel zu wecken.

Beachte außerdem: Auch ein Screenshot kann manipuliert sein. Prüfe daher Screenshots von Transaktionen oder Dokumenten besonders kritisch, da sie leicht gefälscht werden können und nicht immer als Beweismittel taugen.

Doch: In einer Zeit, in der KI täuschend echte Bilder erzeugen kann, reicht der menschliche Blick oft nicht mehr aus. Genau hier kommen technische Lösungen ins Spiel – damit Du nicht länger allein entscheiden musst, was echt ist und was nicht.

Dieser Schaden wurde fingiert.

Wie erkenne ich durch KI erstellte Bilder?

Nicht nur klassische Bildbearbeitung ist ein Problem – auch künstliche Intelligenz und moderne Technologien werden immer häufiger eingesetzt, um Bilder zu erzeugen oder zu verändern. KI-Tools können auf dem Computer, Smartphone oder Handy genutzt werden, um Bilder und Videos direkt im Browser auf Manipulationen, Metadaten und Infos zu überprüfen.

Das Ergebnis: täuschend echte Deepfakes. Tools wie Midjourney, DALL E oder ähnliche Software können in Sekunden Bilder erstellen, die aussehen, als wären sie real fotografiert worden.

Aber es gibt typische Anzeichen, auf die Du achten kannst, um KI-Bilder zu entlarven.

Anzeichen die auf KI-generierte Bilder hinweisen

Unlogische Details im Bild: KI-Modelle basieren auf riesigen Datenmengen – sind diese unvollständig oder fehlerhaft, entstehen seltsame Elemente. Achte auf verdrehte Finger, falsch positionierte Ohren, verschmelzende Objekte oder verzerrte Hintergründe. Ein bekanntes Beispiel ist ein KI-generiertes virales Bild, das eine Daunenjacke auf eine ungewöhnliche Weise darstellt.

Unnatürliche Schatten und Lichtquellen: Besonders bei Gesichtern fällt auf, dass Licht und Schatten oft nicht realistisch sind. Schau genau auf die Bereiche um die Augen, unter den Brauen oder entlang der Nase. Stimmen die Schattenwürfe nicht, ist das ein starkes Indiz für einen Deepfake.

Spiegelungen in Brillen oder Gläsern: Trägt die abgebildete Person eine Brille? Dann lohnt sich ein Blick auf die Reflexionen. Fehlen diese ganz oder wirken sie unlogisch, ist Vorsicht geboten.

Zu perfekte Haut: Viele KI-generierte Porträts zeigen makellose, fast plastikartige Haut ohne Poren oder natürliche Unebenheiten. Das wirkt zwar auf den ersten Blick schön – ist aber oft ein Hinweis auf eine künstliche Herkunft.

Auffällige Texte oder Textfragmente: KI-generierte Bilder enthalten oft fehlerhafte oder verzerrte Texte. Die Analyse von Texten und Textinhalten in KI-Bildern, etwa durch OCR-Technologien, kann helfen, Fälschungen zu erkennen.

Trotz aller Tipps: Deepfakes werden immer besser und realistischer. Selbst geübte Augen kommen an ihre Grenzen. Besonders bei Deepfakes, bei denen Gesichter in Videos durch KI-Technologien manipuliert oder ausgetauscht werden, ist die Erkennung schwierig.

Deshalb gibt es mittlerweile spezialisierte Tools, mit denen Du Bilder technisch überprüfen kannst. Die Genauigkeit dieser Tools ist entscheidend, um manipulierte Bilder und Videos zuverlässig zu identifizieren.

Wie kann man ein Bild prüfen oder zurückverfolgen?

Du hast ein Bild gesehen und bist unsicher, ob es echt ist oder woher es stammt? Zum Glück gibt es auch für Dich als Privatperson einfache Möglichkeiten, ein Bild zu überprüfen oder seinen Ursprung nachzuvollziehen.

Das kannst Du tun:

Google-Rückwärtssuche verwenden: Gehe auf Google Bilder, klicke auf das Kamera-Symbol und lade das Bild hoch – oder füge den Bildlink ein, wenn das Bild online ist. Mit einem Rechtsklick auf das Bild im Browser kannst Du außerdem die Bildadresse kopieren oder weitere Optionen aufrufen. Die Suchmaschine zeigt Dir, auf welchen Webseiten das Bild bereits verwendet wurde – inklusive Veröffentlichungsdatum und Kontext.

Tineye oder andere Bildersuchdienste nutzen: Neben Google gibt es spezialisierte Dienste wie TinEye, die besonders auf visuelle Ähnlichkeit achten und alternative Versionen oder ältere Veröffentlichungen eines Bildes finden können.

Metadaten auslesen: Wenn Du die Bilddatei auf Deinem Gerät hast, kannst Du versuchen, die sogenannten EXIF-Daten auszulesen. Diese enthalten oft Informationen über Aufnahmezeitpunkt, Kamera oder verwendete Software. Kostenlose Tools wie ExifTool oder Metapicz helfen Dir dabei. Hinweis: Bei vielen Bildern aus dem Internet wurden die Metadaten allerdings entfernt.

Social-Media-Kontext prüfen: Wird das Bild z. B. über WhatsApp, Telegram oder Instagram verbreitet, lohnt sich ein Blick auf die Kommentare, Zeitstempel oder ursprünglichen Accounts. Oft findest Du dort Hinweise darauf, wann und warum das Bild erstmals geteilt wurde.

Diese Schritte können Dir helfen, Fakes zu entlarven, manipulierte Inhalte zu hinterfragen und nicht auf gezielte Desinformation hereinzufallen. Gerade in Zeiten von KI und Deepfakes ist ein gesunder Zweifel ein wichtiger Schutzmechanismus.

Wie können sich Unternehmen und Organisationen vor Betrug durch Fake Bilder schützen?

Unternehmen sehen sich zunehmend mit der Herausforderung konfrontiert, sich gegen Bildmanipulationen und betrügerische Deepfakes zu schützen, die finanzielle Schäden und Reputationsverluste verursachen können. Häufig sind sie dabei mit gefälschten Dokumenten und manipulierten Inhalten auf verschiedenen Plattformen konfrontiert.

Viele stehen dabei vor der Herausforderung, dass sie weder die Zeit noch die personellen Ressourcen haben, um eine Vielzahl unterschiedlicher Tools einzusetzen und auszuwerten. Unterschiedliche Anwendungen bringen oft komplexe Abläufe mit sich und erschweren so den effizienten Einsatz im Tagesgeschäft. Deshalb sind Unternehmen zunehmend auf eine zentrale Prüfmethode angewiesen, die verschiedene Analyseverfahren bündelt und automatisiert ausführt.

Genau hier setzt fraudify an: Unsere Bildforensik-Lösung nutzt hoch entwickelte KI, um manipulierte Bilder zuverlässig zu erkennen.

Dabei analysiert fraudify verschiedene Bildmerkmale wie Bildrauschen, Metadaten, Unschärfen und Übergänge zwischen Bildbereichen, um Hinweise auf Retuschen, Montage oder KI-basierte Manipulationen zu finden. Die Überprüfung von Quellen und die Analyse aller Merkmale und Inhalte sind entscheidend, um Betrugsfälle zu erkennen und die Authentizität von Dokumenten und Bildern zu validieren.

So lassen sich beispielsweise manipulierte Schadenbilder in der Versicherungsbranche aufdecken, bei denen Betrüger mit gefälschten Fotos höhere Entschädigungen erlangen wollen. Aber auch in anderen Branchen schützt fraudify Unternehmen vor Fake-Bildern, die als gefälschte Beweise oder zur Täuschung in betrügerischen Szenarien genutzt werden.

Durch die automatisierte und nachvollziehbare Analyse von Bildern bietet fraudify eine verlässliche Grundlage, auf der Unternehmen Entscheidungen treffen können. Kombiniert mit gezielter Schulung und Sensibilisierung der Mitarbeiter erhöht diese Technologie den Schutz vor Deepfake-Angriffen deutlich und trägt dazu bei, Betrugsversuche frühzeitig zu erkennen und abzuwehren. Mehr zu den Gefahren durch Bildmanipulationen findest Du hier.

So gibt fraudify Unternehmen ein wichtiges Werkzeug an die Hand, um sich in einer Zeit immer raffinierterer digitaler Manipulationen wirksam zu schützen.

Fazit

In einer Zeit, in der Bildmanipulationen durch KI und digitale Werkzeuge immer einfacher und raffinierter werden, ist der Schutz vor Betrug und Täuschung für Unternehmen unverzichtbar. Die Überprüfung aller Inhalte und Quellen ist dabei entscheidend, um Manipulationen frühzeitig zu erkennen und die Echtheit von Dokumenten und Bildern zu gewährleisten.

Unternehmen sollten auf Werkzeuge zurückgreifen, um die Überprüfung von Inhalten, Quellen und Metadaten effizient zu gestalten. Statt sich mit einer Vielzahl einzelner Tools auseinanderzusetzen, brauchen Unternehmen jedoch eine zentrale, zuverlässige Lösung wie fraudify, die alle relevanten Prüfverfahren vereint und automatisiert durchführt.

So lassen sich manipulierte Bilder und veränderte Inhalte schnell erkennen, Risiken minimieren und Entscheidungen auf eine sichere Basis stellen.

Nur mit einer intelligenten Bildforensik bist Du heute wirklich gewappnet, um Betrügern keinen Raum zu geben und den Schutz Deiner Firma effektiv zu gewährleisten. Letztlich ist es unerlässlich, alles zu überprüfen – von den Inhalten über die Quellen bis hin zu den Plattformen –, um Manipulationen und Fälschungen zuverlässig zu entlarven.

FAQ - Wie kann ich Fake Bilder erkennen?

Achte auf unlogische Licht- und Schattenverhältnisse, verzerrte oder doppelte Objekte im Hintergrund, seltsam verschwommene Bereiche und ungewöhnliche Proportionen (z. B. verdrehte Finger oder unnatürlich platzierte Ohren). Mehrere solcher Auffälligkeiten zusammen sprechen stark für eine Manipulation.

Typische Hinweise sind zu perfekte, „plastikartige“ Haut ohne Poren, fehlende oder unlogische Spiegelungen (z. B. in Brillengläsern), verzerrte oder fehlerhafte Textfragmente sowie seltsame Details in kleinen Bildelementen. Solche Artefakte entstehen, wenn das KI-Modell Informationen falsch kombiniert.

Verwende die Rückwärtsbildsuche von Google Bilder oder spezialisierte Dienste wie TinEye, um gleiche oder ältere Versionen des Bildes im Web zu finden. So lässt sich oft der ursprüngliche Kontext oder das erste Veröffentlichungsdatum herausfinden.

EXIF-Daten (Aufnahmezeit, Kamera, Software) können Hinweise liefern, sind aber oft entfernt oder verändert. Wenn Metadaten fehlen oder unplausibel sind, kann das ein Indiz sein — gilt aber nicht als alleiniger Beweis. Tools wie ExifTool oder Metapicz helfen beim Auslesen.

Automatisierte Prüfungen analysieren Bildrauschen, Übergänge (Splicing), Unschärfen, Lichtkonsistenz und Metadaten sowie OCR-Analysen für Textfehler. Kombinationen dieser Tests liefern belastbare Hinweise auf Retusche, Montage oder KI-Erzeugung.

Immer seltener — besonders bei hochwertigen Deepfakes reicht der menschliche Blick oft nicht mehr aus. Kleine Unstimmigkeiten helfen zwar, aber für sichere Ergebnisse sind technische Prüfungen oder spezialisierte Tools notwendig.

Kurz prüfen: Quelle nachverfolgen (Rückwärtsbildsuche), Kontext lesen, Metadaten prüfen (wenn möglich) und auf auffällige Details achten. Bei wichtigen oder sensiblen Inhalten lieber mehrere Quellen verifizieren, bevor das Bild weiterverbreitet wird.

Unternehmen sollten zentrale Prüfverfahren durch Software wie fraudify einführen, Mitarbeitende schulen und auf automatisierte Bildforensik-Lösungen setzen, die verschiedene Prüfverfahren bündeln und skalierbar auswerten (z. B. zur Erkennung gefälschter Schadensbilder in Versicherungsfällen).

Der Kontext ist entscheidend — ein echtes Foto kann irreführend eingesetzt werden, wenn Datum, Ort oder Begleittext manipuliert werden. Deshalb gehört zur Prüfung immer die Recherche, wo und wann das Bild zuerst veröffentlicht wurde.

Ja — Lösungen wie fraudify, die verschiedene Analysen (Rausch- und Splicing-Checks, Metadaten, OCR, Quellenprüfung) automatisieren und nachvollziehbar protokollieren, sind besonders für Unternehmen sinnvoll, weil sie große Mengen an Bildern effizient prüfen und Betrugsfälle dokumentiert aufdecken.