I pericoli della manipolazione delle immagini e come fraudify riconosce le immagini manipolate.

La manipolazione delle immagini non è mai stata così facile come oggi. Con pochi clic, foto ordinarie possono essere trasformate in falsi ingannevoli, a volte per divertimento, a volte per amara serietà. Spesso dietro l'editing c'è una chiara intenzione, ad esempio quella di ingannare deliberatamente o di evocare determinate reazioni. Mentre i filtri AI e i trucchi di Photoshop offrono intrattenimento sui social media, altri utilizzano le stesse tecniche per ingannare in modo mirato: fake news, frodi di identità o prove falsificate non sono più una rarità. Ma come si fa a distinguere le immagini reali da quelle manipolate?

In questo articolo affrontiamo il tema della manipolazione delle immagini: quali sono i metodi? Come si riconoscono le immagini manipolate? E come può la tecnologia moderna aiutarvi a smascherare in modo affidabile i falsi? Utilizzando esempi pratici, mostriamo come la nostra soluzione di image forensics fraudify renda visibili anche le manipolazioni nascoste, dal semplice ritocco ai complessi deepfake.

Cos'è la manipolazione delle immagini - definizione

La manipolazione dell'immagine si riferisce all'alterazione deliberata di una foto per simulare una realtà diversa - in altre parole, per mostrare qualcosa che non è mai esistito. Oggi è possibile utilizzare mezzi tecnici per modellare, abbellire o falsificare un'immagine in qualsiasi modo.

La fotografia costituisce la base per molte manipolazioni, in quanto è possibile intervenire sull'immagine sia al momento dello scatto sia al momento della successiva modifica.

La manipolazione può avvenire in tutte le fasi della creazione dell'immagine:

Prima dello scatto, l'immagine viene messa in scena: oggetti, persone o intere scene vengono deliberatamente disposti per ottenere un determinato effetto.

Durante lo scatto, si utilizzano tecniche come l'esposizione multipla per influenzare l'immagine mentre viene creata.

Dopo aver scattato la foto, inizia l'elaborazione vera e propria dell'immagine. In passato si chiamava ritocco o montaggio; oggi sono i filtri, gli strumenti basati sull'intelligenza artificiale e il ritocco digitale a smussare, modificare o ricomporre completamente le immagini.

Il risultato spesso non è più un documento della realtà, ma una costruzione deliberata. In tempi di social media, pubblicità e immagini AI, il confine tra una foto reale e un'illusione perfetta sta diventando sempre più labile.

Quali sono i tipi di manipolazione delle immagini?

Non tutte le manipolazioni di immagini sono uguali. Tra un filtro innocuo e un deepfake ingannevolmente reale esiste un'ampia gamma di tecniche che possono essere suddivise grossomodo in tre categorie: Vari effetti, come filtri tecnici o cambi di prospettiva, possono essere utilizzati per modificare in modo specifico le immagini al fine di ottenere determinati effetti visivi o risultati creativi.

1. ritocco e interventi cosmetici

Si tratta di interventi classici di modifica delle immagini, come la rimozione delle macchie della pelle, l'attenuazione delle rughe o la schiaritura dei colori. Tali modifiche non vengono utilizzate solo sulle immagini, ma anche per manipolare i documenti al fine di influenzarne l'autenticità. Spesso questi interventi sembrano innocui, ma possono avere un effetto fuorviante a seconda del contesto, ad esempio nella pubblicità o nelle rappresentazioni politiche.

2. montaggio e composizione di immagini

In questa fase, diversi elementi dell'immagine vengono combinati per formare un nuovo insieme. In un fotomontaggio, diverse parti di un'immagine o persino la testa di una persona possono essere inserite in un'area diversa dell'immagine. I fotomontaggi sono spesso utilizzati per rimuovere o aggiungere oggetti al fine di modificare l'autenticità dell'immagine.

Singole aree di un'immagine vengono manipolate per nascondere o enfatizzare determinate informazioni. Un volto viene montato su un altro corpo, gli oggetti vengono rimossi o aggiunti. Con l'aumento della qualità degli strumenti (ad esempio Adobe Photoshop e/o editor supportati da AI), queste manipolazioni diventano sempre più difficili da riconoscere.

3. deepfakes e AI generativa

L'ultimo livello di falsificazione delle immagini si basa sull'intelligenza artificiale. Le tecnologie deepfake possono imitare volti, voci e persino movimenti in modo ingannevolmente realistico. È possibile sostituire la foto originale di una persona con un'immagine manipolata in modo da cambiarne deliberatamente l'identità o l'aspetto.

Con l'aiuto dell'intelligenza artificiale, è possibile modificare o rigenerare non solo singole persone, ma anche interi sfondi o più persone in un'immagine, facilitando l'editing creativo e le regolazioni visive.

L'approccio interpretativo all'editing delle immagini con l'IA consente di trasmettere un messaggio, un'opinione o un effetto estetico specifico piuttosto che una semplice rappresentazione della realtà. I giornalisti svolgono un ruolo cruciale nell'esporre e riportare in modo trasparente i deepfake e la manipolazione delle immagini per informare il pubblico sulle possibili manipolazioni.

I pericoli della manipolazione delle immagini

I metodi per manipolare le identità dei media esistono da molti anni. È noto da tempo anche che le immagini possono essere alterate in vari modi. Tuttavia, mentre un tempo era estremamente complesso falsificare in modo realistico i media dinamici come i video o le registrazioni sonore, la situazione è cambiata radicalmente con l'uso dell'intelligenza artificiale: Oggi è possibile creare anche falsi di alta qualità con uno sforzo relativamente ridotto e senza competenze approfondite. Questo comporta un rischio considerevole per le aziende e i privati, poiché i media manipolati possono causare problemi di protezione dei dati, conseguenze legali e una perdita di fiducia.

Tentativi di frode attraverso i deepfake

Le moderne tecnologie di intelligenza artificiale per la manipolazione delle immagini non solo aprono nuove possibilità creative, ma vengono anche sempre più spesso utilizzate per scopi fraudolenti. Un esempio noto è la distribuzione di un video deepfake in cui una celebrità sembra fare dichiarazioni politiche che non ha mai fatto, al fine di influenzare l'opinione pubblica. Sia per ingannare sui social media, sia per creare video falsi di prove o per nascondere le identità: I metodi consentono di creare falsi visivamente convincenti, difficili da smascherare anche per occhi esperti. Particolarmente perfido è il loro utilizzo nei cosiddetti scenari di frode deepfake, in cui video o immagini manipolati vengono utilizzati in modo mirato per ingannare la fiducia, falsificare le identità o diffondere disinformazione.

Esempio 1: truffa Deepfake CFO a Hong Kong

Un esempio particolarmente impressionante dell'uso improprio di queste tecnologie è avvenuto a Hong Kong all'inizio del 2024: Un dipendente di una multinazionale è stato indotto con l'inganno a trasferire circa 25 milioni di dollari USA a dei truffatori utilizzando una videoconferenza dall'aspetto ingannevole e reale. I truffatori hanno usato deepfakes generati dall'AI per imitare visivamente e acusticamente il direttore finanziario e altri dirigenti dell'azienda. Tutte le persone coinvolte sono apparse così autentiche che il dipendente, nonostante lo scetticismo iniziale per un'e-mail insolita, alla fine ha seguito le istruzioni.

Questo esempio non lascia dubbi sulla necessità di misure di protezione complete contro i tentativi di frode basati su deepfake. Quando anche dipendenti esperti in un ambiente professionale possono essere ingannati da video deepfake dall'aspetto realistico, il solo giudizio umano non è più sufficiente.

Le aziende devono investire maggiormente in soluzioni tecniche come l'image e video forensics per verificare in modo affidabile l'autenticità dei contenuti visivi. Anche la sensibilizzazione e la formazione su come affrontare i falsi dell'intelligenza artificiale dovrebbero far parte di qualsiasi strategia di sicurezza, perché il prossimo attacco deepfake non è una questione di se, ma di quando.

Esempio 2: Deepfakes in campagna elettorale

Un altro esempio allarmante riportato da Stern proviene dalla campagna elettorale tedesca: nel gennaio 2025 ha fatto scalpore un video manipolato in cui il cancelliere federale Olaf Scholz sembra fare una capriola sul leggio del Bundestag - un deepfake, ovviamente.

Ancora più grave: nel novembre 2024, il deputato SPD Bengt Bergt ha postato un video generato dall'AI in cui il candidato cancelliere della CDU Friedrich Merz avrebbe dichiarato: "Vi disprezziamo! E disprezziamo la democrazia". Sebbene Merz non abbia mai pronunciato queste parole, il video ha provocato indignazione e scuse da parte di Bergt, dimostrando in modo impressionante come tali contenuti vengano utilizzati per destabilizzare il discorso pubblico.

Con il rapido sviluppo della manipolazione di immagini e video basata sull'intelligenza artificiale, sta diventando sempre più difficile per gli editori, i verificatori e gli operatori delle piattaforme distinguere i contenuti autentici da quelli falsi. Ciò che prima era verificabile con un occhio esperto o con un semplice software ora richiede metodi di analisi forense specializzati. I deepfake che sembrano ingannevolmente autentici spesso non possono più essere smascherati a prima vista, soprattutto quando suono, immagine e contesto sembrano lavorare insieme armoniosamente.

Tentativi di frode attraverso montaggi di immagini e IA generativa

Le immagini ingannevolmente realistiche sono state per lungo tempo appannaggio dell'editing professionale delle immagini, ma con l'avvento dell'IA generativa la situazione è cambiata radicalmente. Oggi è possibile creare foto e manipolazioni di immagini ingannevolmente realistiche in pochi secondi, senza alcuna competenza grafica. Ciò che inizia in modo innocuo come un gioco creativo può rapidamente diventare una seria minaccia.

Esempio 3: frode assicurativa attraverso immagini di danni manipolati

Il progresso degli strumenti digitali non solo apre nuove opportunità, ma anche nuove scappatoie per i tentativi di frode. Ciò è particolarmente evidente nel settore assicurativo: secondo l'Associazione tedesca delle assicurazioni (GDV), circa una denuncia di sinistro su dieci contiene discrepanze. Sempre più spesso i truffatori manipolano le foto presentate con la denuncia di sinistro - ad esempio, utilizzando il ritocco digitale o immagini generate dall'intelligenza artificiale - in modo così abile che la falsificazione è a malapena riconoscibile a occhio nudo. Gli strumenti necessari sono economici, facilmente disponibili e non richiedono alcuna competenza tecnica.

Immaginiamo che qualcuno voglia denunciare un piccolo danno alla propria compagnia assicurativa, ad esempio un paraurti graffiato. Ma invece di inviare la foto reale, modifica digitalmente l'immagine in modo che sembri che l'intero parafango sia ammaccato o che il veicolo sia gravemente danneggiato. Con pochi clic, un graffio innocuo diventa un costoso danno da incidente. Tali manipolazioni dell'immagine appaiono credibili a prima vista, ed è proprio in questo caso che l'analisi forense delle immagini diventa fondamentale per rendere visibili i falsi e riconoscere tempestivamente le frodi.

È inoltre allarmante il fatto che, secondo il GDV, il 16% degli autori di frodi utilizza già forum e reti online per informarsi su metodi e trucchi prima di commettere il reato. Di conseguenza, l'impegno richiesto per un controllo accurato delle immagini sta aumentando, così come la necessità di strumenti di analisi forense.

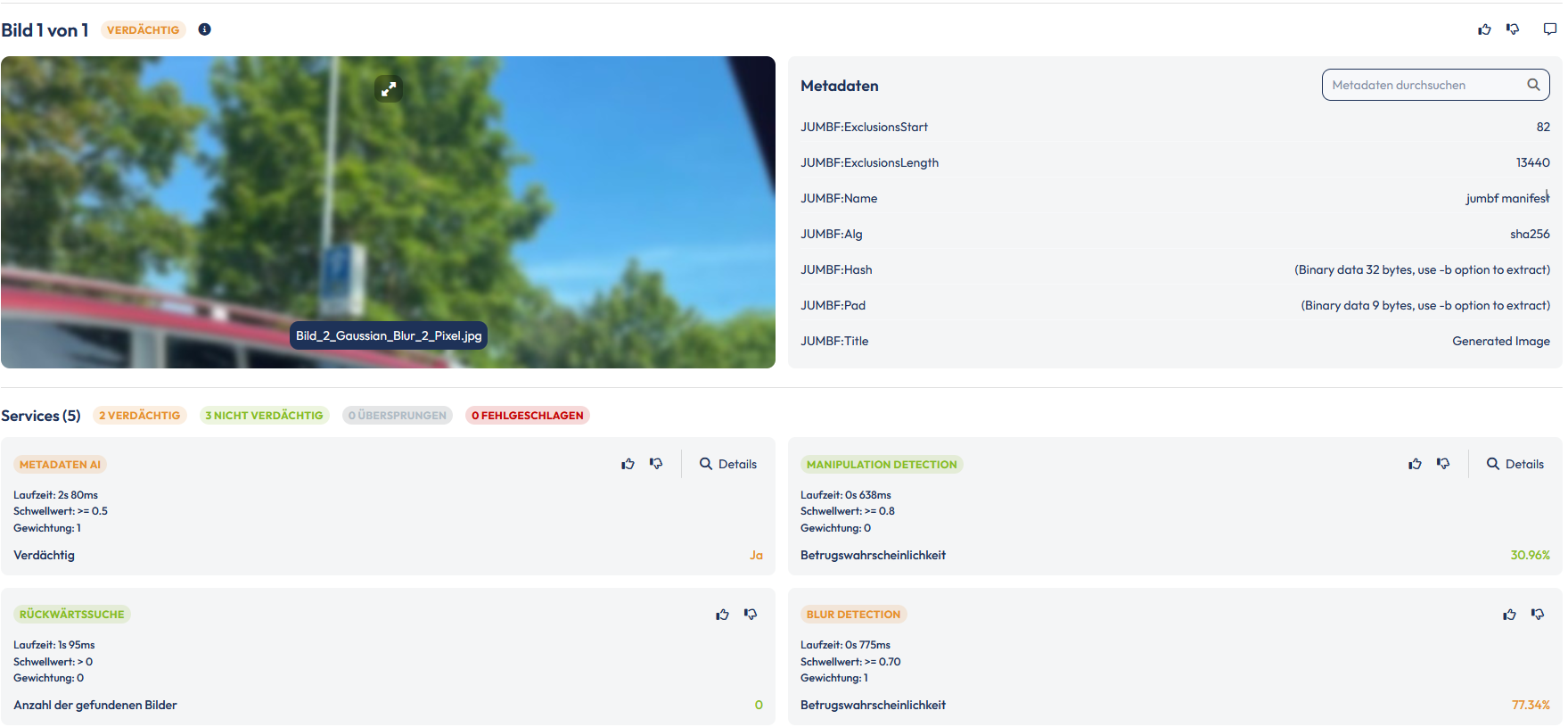

Dieses Bild wurde manipuliert.

Auch dieser Schaden wurde fingiert.

fraudify warnt vor manipulierten Bildbereichen.

Vieles deutet auf Manipulationen hin.

Le indagini forensi sulle immagini, come fraudify, possono fermare le frodi attraverso la manipolazione delle immagini?

Alla luce della crescente diffusione delle falsificazioni di immagini digitali, diventa sempre più importante riconoscere le manipolazioni in una fase iniziale, prima che causino danni finanziari o di reputazione. Con la nostra soluzione fraudify, offriamo un potente strumento di image forensics che inizia proprio da qui: analizza le immagini inviate alla ricerca di modifiche sospette, rileva tracce di ritocco, editing o manipolazione generata dall'intelligenza artificiale e fornisce prove tracciabili di potenziali frodi. In questo modo, trasformiamo l'incertezza in fatti verificabili e creiamo una base affidabile per le decisioni.

Come funziona l'image forensics?

Per scoprire efficacemente la manipolazione delle immagini, fraudify utilizza vari metodi forensi che analizzano diverse tracce e irregolarità dell'immagine.

Controllo del rumore: smascherare le irregolarità

Quando si scatta un'immagine digitale, è sempre presente una certa quantità di cosiddetto rumore d'immagine: si tratta di sottili fluttuazioni nella luminosità o nel colore, simili alla grana delle foto analogiche scattate in condizioni di scarsa illuminazione. Questo rumore è normalmente distribuito in modo uniforme sull'intera immagine. Tuttavia, se un'immagine viene successivamente modificata, ad esempio con l'aggiunta di nuovi elementi, è possibile che si verifichino irregolarità nell'andamento del rumore. È proprio qui che interviene il controllo del rumore: Controlla se alcune aree escono dall'inquadratura. Se il rumore di singole sezioni dell'immagine differisce in modo significativo dal resto, si tratta di un forte indizio di una possibile manipolazione, e di un indizio prezioso per la scienza forense delle immagini.

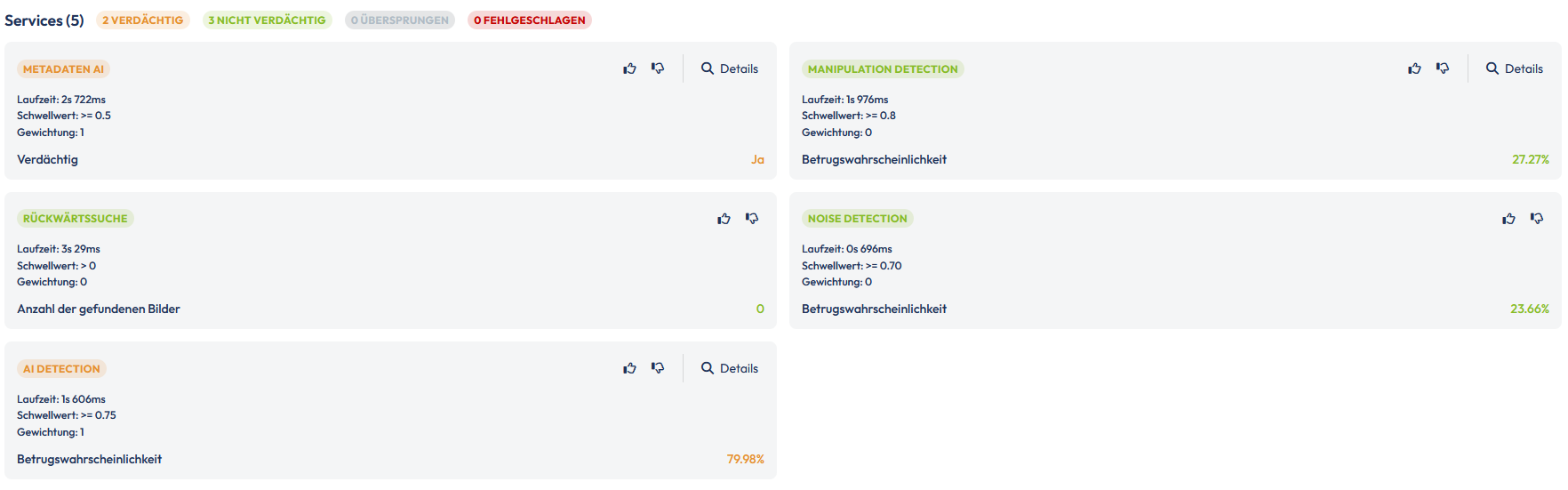

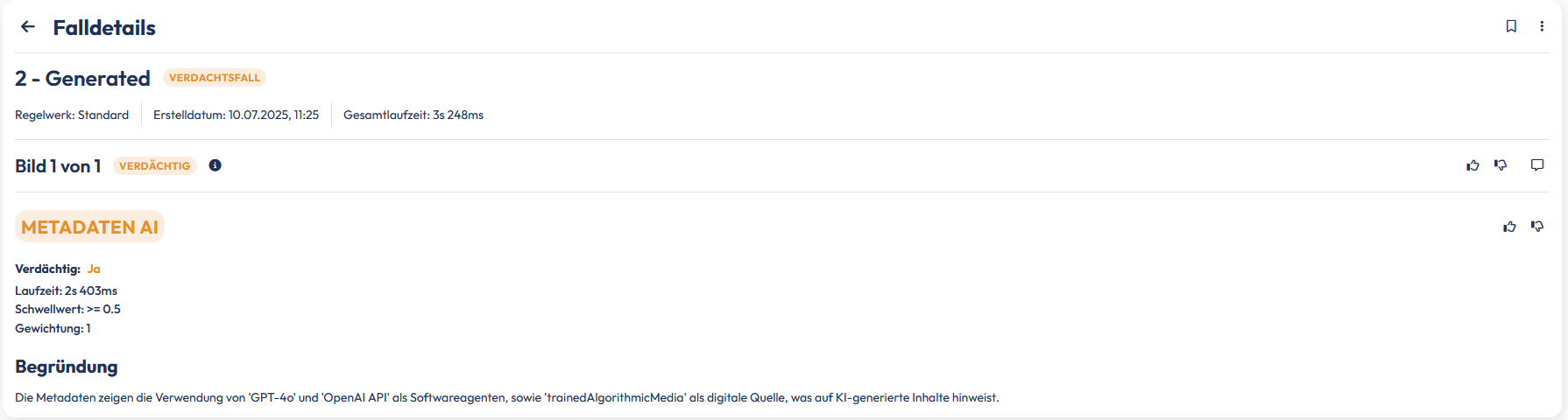

Analisi dei metadati: indagare sugli indizi nascosti

Le immagini digitali di solito contengono informazioni, note come metadati, che memorizzano dettagli come le impostazioni della fotocamera, l'ora o il luogo in cui l'immagine è stata scattata. Si tratta di una sorta di "documentazione di accompagnamento" digitale dell'immagine.

La nostra analisi dei metadati controlla queste informazioni alla ricerca di anomalie. Ad esempio, un'immagine generata con l'intelligenza artificiale potrebbe avere una voce nei metadati che consente di trarre conclusioni sull'uso del software - un chiaro segnale che qualcosa non va. Anche i metadati mancanti o modificati successivamente forniscono importanti indizi di una possibile manipolazione dell'immagine. In questo modo, l'analisi aiuta a riconoscere possibili modifiche basate sulle informazioni dell'immagine, anche prima di osservare più da vicino l'immagine stessa.

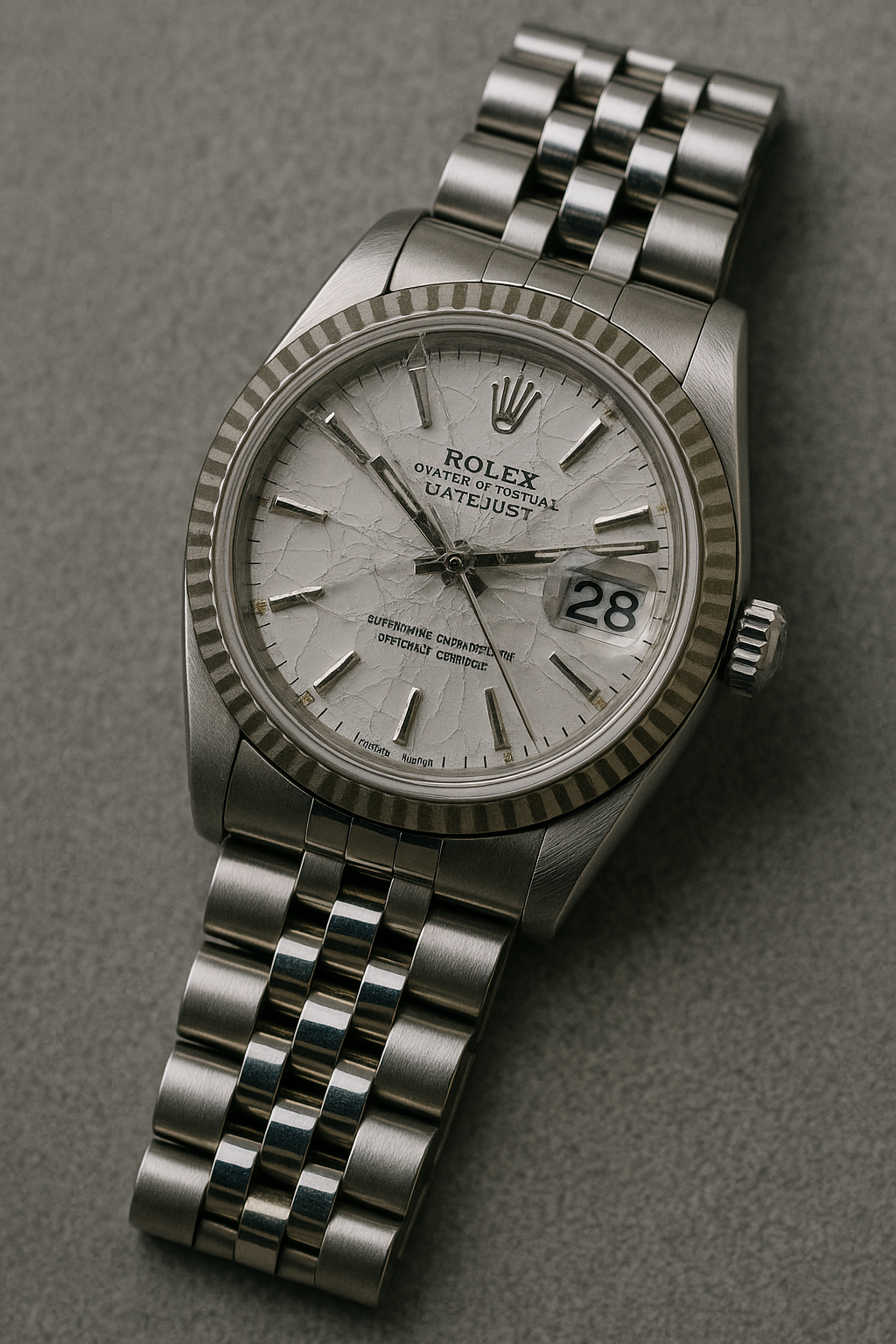

Ist diese Uhr wirklich defekt?

Unstimmigkeiten in den Metadaten deuten auf Manipulation hin.

Rilevamento di giunzioni di immagini: riconoscimento di montaggi di immagini

Quando le immagini vengono manipolate tramite splicing, diverse parti di immagini provenienti da fonti diverse vengono combinate per creare una nuova immagine complessiva apparentemente coerente. Ad un occhio inesperto, il risultato appare spesso credibile, ma il nostro rilevamento dello splicing rivela proprio questi inganni. Le transizioni incoerenti tra le singole aree dell'immagine possono essere una chiara indicazione che l'immagine è stata assemblata da fonti diverse. Questa tecnica è particolarmente utile per identificare montaggi di immagini complesse, ad esempio nel caso di foto di danni falsificate o di prove manipolate in documenti fraudolenti.

Schwer zu sagen, ob dieses Bild manipuliert wurde.

fraudify erkennt den hinzugefügten Wasserzähler.

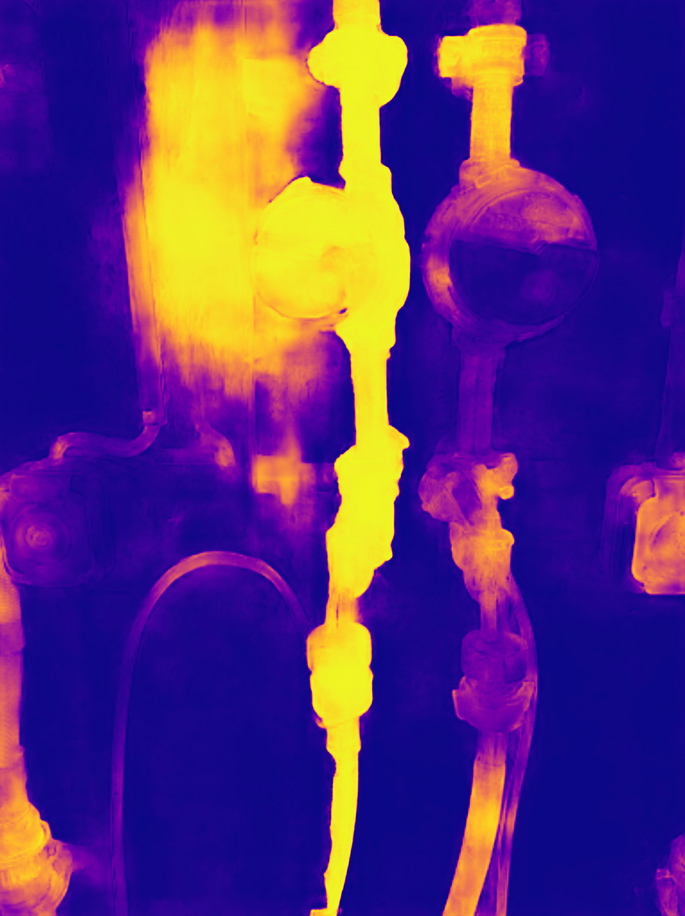

Rilevamento della sfocatura: riconoscere le aree sfocate

Nell'ambito della forense delle immagini, il rilevamento della sfocatura si riferisce all'individuazione automatica di aree sfocate nelle immagini digitali per rilevare manipolazioni o valutare la qualità dell'immagine. La sfocatura può essere usata deliberatamente per nascondere i dettagli, ad esempio quando si ritoccano volti o oggetti. Analizzando i bordi, le componenti di frequenza o utilizzando metodi come la varianza laplaciana, è possibile determinare se e dove la sfocatura è presente nell'immagine. Differenze evidenti nella sfocatura tra le aree dell'immagine possono indicare modifiche successive e quindi possibili falsificazioni.

Originalbild

Bild mit Weichzeichner

fraudify erkennt Weichzeichner

Conclusione: fraudify come chiave nella lotta alla manipolazione delle immagini

In un'epoca in cui le immagini manipolate e i contenuti generati dall'intelligenza artificiale diventano sempre più convincenti e facili da creare, sono necessari metodi affidabili per scoprire questi inganni. La nostra soluzione fraudify offre esattamente questo: un'analisi forense delle immagini potente e automatizzata che rende visibili le manipolazioni, consente analisi comprensibili e supporta quindi decisioni fondate.

Che si tratti del settore assicurativo, dei media o delle autorità investigative, fraudify è lo strumento preferito quando si tratta di contrastare efficacemente i tentativi di frode basati sulle immagini e di scoprire la manipolazione delle immagini. Parlate con noi e non date ai truffatori una possibilità: vi mostreremo come funziona fraudify con una demo dal vivo!

FAQ - Perché la manipolazione delle immagini è così pericolosa?

Per manipolazione dell'immagine si intende qualsiasi modifica mirata a una foto per simulare una realtà diversa, ad esempio attraverso il ritocco, il montaggio, i filtri o l'IA generativa. Anche la disposizione delle scene prima dello scatto o le esposizioni multiple durante la ripresa possono far parte del processo. La post-elaborazione comprende la modifica dei colori, la rimozione o l'aggiunta di oggetti, ma anche sofisticate tecniche di deepfake.

Esistono tre categorie principali:

Ritocco e interventi cosmetici: levigare la pelle, rimuovere le imperfezioni, correggere il colore, ecc.

Montaggio/composizione di immagini: assemblaggio di elementi di immagini provenienti da fonti diverse, inserimento o rimozione di oggetti, modifica di sfondi.

Deepfakes e AI generativa: sistemi di AI che imitano volti, voci o intere scene in modo ingannevolmente realistico, oppure utilizzano sfondi e persone generati dall'AI.

Ci sono diversi rischi da considerare:

Perdita di fiducia se le immagini manipolate vengono rese pubbliche e la credibilità viene minata.

Conseguenze legali, ad esempio in caso di prove falsificate o frodi.

Uso improprio per disinformazione, influenza sulle elezioni, frode d'identità o frode assicurativa.

Problemi di protezione dei dati se vengono modificati o pubblicati contenuti sensibili.

Diversi metodi forensi aiutano in questo senso:

Analisi del modello di rumore: verifica se il rumore dell'immagine è distribuito in modo uniforme o se ci sono deviazioni evidenti.

Analisi dei metadati: esame dei dati incorporati, come le impostazioni della fotocamera o l'ora - i metadati illogici o mancanti possono essere un'indicazione di manipolazione.

Rilevamento di giunzioni: rilevamento di transizioni in cui parti dell'immagine sono state combinate da fonti diverse.

Rilevamento della sfocatura: analisi delle aree sfocate che vengono deliberatamente oscurate, ad esempio per nascondere i dettagli.

L'image forensics si riferisce alle tecniche e alle tecnologie utilizzate per visualizzare i falsi. Queste includono

Procedure di ispezione automatizzate che rilevano le irregolarità (ad esempio, deviazioni di rumore, metadati illogici, errori di giunzione).

Strumenti che contrassegnano le aree manipolate o forniscono informazioni come "sospetto ritocco".

Utilizzo in settori ad alto rischio (assicurazioni, media, legale) per riconoscere tempestivamente frodi o inganni e limitare i danni.

Esaminare criticamente il materiale dell'immagine, non credere immediatamente a tutte le impressioni visive. Esaminare dettagli come ombre, proporzioni e condizioni di illuminazione.

Utilizzare software o strumenti forensi appositamente sviluppati per riconoscere le manipolazioni.

Formare i dipendenti affinché sviluppino una sensibilità alle tecniche di manipolazione.

Protezione legale, ad esempio attraverso requisiti contrattuali o regole di conformità, in particolare per il contenuto delle immagini, i rapporti sui danni, ecc.